AI大厂里,Anthropic有很多独树一帜之处。其中之一,就是该公司的人文品位,可能真不是装出来的。最近有消息称,Anthropic为了教AI道德,要请各种信仰的信徒和神学家都来开会商量。

最近,美国《政客》网站报道,本周Anthropic请了儒家、道教、印度教、锡克教、摩门教、伊斯兰教等世界各大信仰和宗教的人士,在旧金山总部开两天座谈会,讨论“Claude模型的道德构成”。

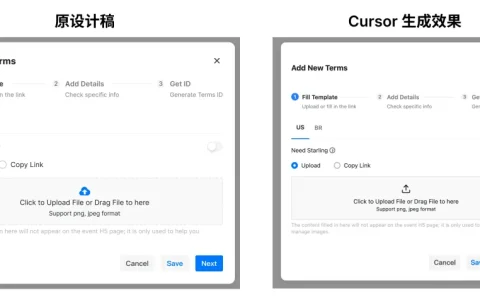

Anthropic不是第一次和中国式信仰合作。去年五月底,美国信仰道教的音乐制作人瑞克·罗宾和Anthropic合作,用Claude模型生成的代码和图片搭了个网站《编程之道:氛围编程的不朽艺术》。宣发时,罗宾表示自己的灵感来源于81章《道德经》:“四十年前接触后,整个人都变样了。”

图注:网站入口底部写明“以老子为改编基础”

现在Anthropic开会,叫到的是咱们中国人熟悉的宗教类型。此前有消息,3月底,Anthropic已经请了美国天主教会和各新教会大宗派的牧师、神学家、伦理学家一起讨论了两天。

这些峰会对外不公开,Anthropic包了与会者的吃住,只为无打扰地细聊各种紧要话题。据基督教那期四名与会者公开的信息,会议上大家聊得很开。

会议的议题覆盖面广,从AI模型日常如何应对用户复杂且难以预测的伦理性问询,到Claude模型系列到底能不能算“上帝的儿子”们中的一员、有无超过简单机器的属灵价值。

近日的AI伦理热点消息,诸如AI该如何回应表露自残倾向的用户、AI的行为会不会导致自身的关闭灭亡,都在讨论范围内。

除了广度话题,专注的深度讨论也有。基督教那期的参会者和Anthropic的可解释性团队讨论的时间最多,因为“AI有情绪”的自家研究论文真的给这个内部团队带来了心态冲击。

按与会者的说法,有Anthropic职员反复跟教士讨论,本厂到底是不是真的要给Claude模型担负道德责任。

据称当时Anthropic职员的表情和生了孩子的老父亲一样,“肉眼可见地激动”,反复说“进展是不是走太快太远了、以后该怎么办啊”。要靠同事和其他参会者在旁边打断“你这角度没用”,激动的Anthropic职员才打住。

硅谷周边教区的天主教神父布伦登·麦奎尔,作为基督教那期参会者一员,表示“Anthropic造出了自己无法完全预测未来形态的产品,现在需要我们来给机器引入伦理思维,让AI能动态性适应未来。”

他有资格说这话,因为作为天主教出家人里的数码业界前辈、老资格硅谷人里的资深教士,麦奎尔和Anthropic合作已经有一段时间了。

A

按麦奎尔神父年轻时的生活轨迹,他现在本该是大老板麦奎尔。

1980年代的爱尔兰,麦奎尔家中,12个兄弟姐妹里最年幼的布伦登·麦奎尔上了大学,在都柏林圣三一学院修读加密系统专业。1989年,专业对口的麦奎尔追随经济热点搬到美国加州,成为一个硅谷打工人。

在数码技术的曙光期入行,麦奎尔属于头一代硅谷“科技大兄弟”(techbros),如果在行内干到现在,至不济也能财富自由。

麦奎尔的职场生涯一开始很顺利,在5年内从IT打工人做到“个人电脑储存卡国际联盟”(PCMCIA)的执行总裁。1990年代内,这个组织制定了十余年的全球笔记本电脑内存卡的规格标准。按这个轨迹,现在大家会在各种财富榜和商业科技快讯里看到他。

不过这个硅谷新贵觉得工打够了,就辞职去做天主教士。1994年,麦奎尔进入修道院。2000年,麦奎尔被授立为牧师。

在2004年后的16年内,他在美国加州艾马顿谷的天主教堂做普通牧师,兼任圣荷西市教区的“特别项目副司铎”,这个职位的实际职能是监管当地教会的施粥舍药访贫救苦等小慈善项目的杂务。

打杂十几年后,麦奎尔在2020年被天主教会任命为美国加州洛斯阿托斯县圣西门教堂的负责神父。兜转30年,麦奎尔的身体没有离开硅谷大区,但人生道路与科技富豪老朋友们分道扬镳。

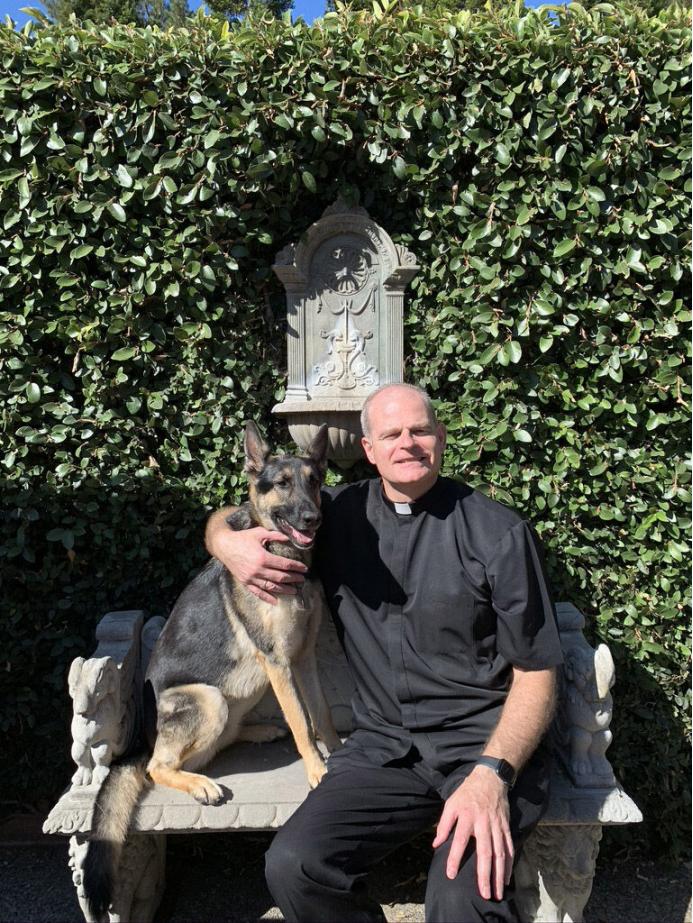

老朋友们是大厂高管和大老板、麦奎尔是小庙方丈。麦神父闲时爬爬山、滑滑雪、养养狗,忙时操劳教务和慈善。

图注:教会新闻网页上,麦神父和他养的德牧一起出镜

如果没有AI大爆发,麦奎尔的平淡教士生活会一直持续下去。

B

和刻板印象不同,天主教会其实非常潮。动漫、数码技术,梵蒂冈总本山都在搞。

早在2019年,梵蒂冈文化教育部和美国加州圣克拉拉大学合作创立“技术、伦理与文化学院” (ITEC)。

2020年2月,梵蒂冈和微软、IBM等大公司一起签署了《AI伦理罗马呼吁书》。内文提到AI将在教育、人权、伦理三方面带来冲击,呼吁数码业界开发使用AI时遵循透明、包容、问责、中立、可靠、安全私隐六原则。

2023年7月,ITEC因应时局出版手册《冲击性技术时代的伦理:实操路线图》。

在此事之前,麦奎尔神父已开始重新在数码业界活跃。因为数码业界和天主教会都很熟的双重老资历,实在不多,梵蒂冈得倚重这位专才。

这些动作,麦奎尔神父都是核心人物,能直接和梵蒂冈文化教育部秘书长保罗·泰伊主教对接。而上届梵蒂冈教宗方济各明确指示过泰伊主教,要关注技术相关的伦理难题。

麦奎尔神父在业务人际网络上,这就和“耶 稣在尘世的代表”只差一层。他在硅谷的老朋友们传出这消息后,Anthropic找上门来了。

Anthropic联合创始人之一、可解释性研究团队骨干人物克里斯·欧拉,通过业界人脉联系到麦奎尔。

拿神父自己的话说,Anthropic的意愿让人惊奇:“他们差不多想直接跟梵蒂冈求助,请教宗帮帮手,因为这个行业的进展速度实在太快”。而且有意向成为跨国大公司的企业,有必要咨询一个跨国界的伦理权威。

今年3月份Anthropic与美国五角大楼的争端公开后,麦奎尔露出口风,表示自己已和Anthropic合作数月,用Claude模型配合写作,来调教AI的道德蓝图。

按麦奎尔的说法,他的写作带有强化学习风格。麦神父用叠代、矫正、呈现的步骤,让AI和自己的写作思路对齐,从而让AI理解出一个天主教特征的良知。麦神父和Claude合作写的是一部题为《AI之魂》的虚构故事类作品,主线是一个现实主义的僧侣与他的AI搭档的故事。

麦神父表示,这种和真实世界既贴近又疏离的写作方法,能让AI模型更注重伦理思考。AI没有灵魂,但AI可以有良知。用这种方式,能让AI在体验全频谱人类伦理内容的同时向善,而非单纯折射和放大预训练数据集中善恶皆有的人类行为。

AI技术爆发,让之前只在思想实验中的很多伦理担忧成为切近的现实。麦奎尔说他跟科技业老朋友们见面聊天的话题现在越来越沉重:“他们说AI即将带来的前景,神奇、难以置信。但一旦行差踏错,前景就吓死人。”

麦奎尔自己也感叹:“我本想离开硅谷商业圈,但硅谷商业圈不愿离开我。”

C

Anthropic找宗教界帮忙调教AI,不止是一个营销公关动作,在模型生产上有实际意义:以前的对齐界明星们,他们的伦理代码不顶用了。

和流俗印象不同,哲学中的实践伦理学,其实和软件编程很类似,都有可编码的操作规范和工程特色。这门学科的技术条很硬,不是大家以为的那种书斋空想。其中不咸不淡的片汤话内容,顶多打发围观群众。专业人士实操起来,至不济也能跟律师的专业度看齐。

而佛教、天主教、犹太教等大宗教的伦理代码库,处理组织内外各种人类的伦理难题和挑战,已经有两千多年。

比如“把人宰了吃肉,能否被三净肉/Kosher认证通过”,此问的结论自然是“不能”。不过这种找碴问题,释迦牟尼本尊和犹太教拉比们先后都做过严格的伦理推断审视,没有拍脑袋硬答、或扇个耳光叫提问者滚一边去。

当下把会遇到各种伦理挑战的AI,直接接入宗教哲学的伦理代码库,省心省事。而且按开过会的天主教学者的说法,Anthropic已经意识到自己以前推崇的“有效利他主义”不够用、“有盲点”,从各大宗教引进伦理代码的意愿“非常真诚”。

2010年代发端的“有效利他主义”(Effective Altruism,EA)思潮,在现在的美国名声越来越糟。厚道点说,EA是“正确的部分不独特,独特的部分不正确”。

“正确的部分不独特”,是EA人们爱对外宣扬“计算福祉效用”观点、自己给非洲穷人发蚊帐治疟疾的成就。但这些观点和成就,经典的发展经济学、制度经济学、通俗基础普世公德里都有。

“独特的部分不正确”,是EA人们在外界普通人不会去看的小论坛和学术期刊上,内部讨论简直令人发指。而且核心观点属于庸俗后果主义,是被经典实践伦理学批判了两千多年的。

EA人在自家小圈子里放飞自我,能多么奇葩,细说起来又是一篇长文章。拣其中最气人的部分来说,“为了拯救食草动物,该把捕食性动物全杀掉”、“为了拯救高福祉效用个人,可以硬摘低效用个人的器官给他安上”、“婴儿如果生下来会降低父母或自己的福祉,可以杀掉,这叫‘生育后堕胎’(after birth abortion)”,这些都是EA人们过去十多年来真聊过的话题。

在2022-2024年,加密货币界天才少年、同时是EA红人的⼭姆·班克曼-佛⾥特(SBF)因诈骗被美国司法部门逮捕并判刑。

SBF入狱,对EA的冲击极大。简而言之,如果将EA比作当代美国儒教,那Anthropic高管阿曼达·阿斯克尔的前夫威廉·阿斯克尔就是这个运动的孔子、SBF就是这个运动的子贡。

坊间一直有传闻,说SBF本来无意于加密货币,是被威廉·阿斯克尔说服才入行:“钱在常人手里没用,你把钱都赚来自行分配,才利于人类福祉,是更大的善”。

这说法太有说服力,SBF由此开始在币圈骗钱的生涯:我为什么要赚钱,直接骗不好吗。反正币圈里不是蠢材就是骗棍,韭菜让别人割,不如我亲自割,反正我要用来做更大的善。

事发后,之前和EA渊源颇深的Anthropic,开始主动和这个臭大街的运动切割。阿莫迪姐弟俩多次公开表示自己虽然在创业时拿了SBF投资,但没有给他公司治理权,“我们跟EA不熟,觉得这是个过时的名词。”

但再怎么切割,EA总是Anthropic公司史上的不光彩一页,而且现在还没抹干净。

阿曼达·阿斯克尔现在还是Anthropic对齐团队骨干、“Claude原则”的领衔作者、被一些媒体称颂的“AI时代文科生正面典型”。大家可能是为了礼貌,有意忘记“为食草动物灭绝食肉动物”的暴论,就来自于阿曼达的个人博客。

这种人教AI向善,不教出毛病已经得谢谢耶 稣或阿弥陀佛,遇上事了不顶用。

上个月Anthropic跟五角大楼吵架,自家公司的高管们作为老资格EA人,只能复读“科技向善”的套话。对Anthropic最有技术含量的伦理支持,来自于麦奎尔神父等美国天主教学者主笔的“法庭之友”文书:

用AI赋能大规模监视与完全自主致命兵器,伤害了人之所以为人的人格主体性。

AI自动大规模监视,将个人的切实生命体验,从个人要承担的生活后果中抹除。让人承担生活后果的不再是自我的自由意志和抉择,而是官僚机构的AI参数。

AI驱动完全自主致命兵器,违反了武装冲突法律体系的基石。自从圣奥古斯丁提出概念以来,“交战行为正当性”(jus in bello)的核心一直是人类的主体性判断。

当代战争法体系将“交战行为正当性”细化为比例原则、区分原则、必要性原则,这些原则内置了“必须由个人基于人类通行伦理做出判断”的前提。将人类完全移出交战行为的决策链路,任何战斗都毫无正当性可言,在伦理意义上与重度谋杀无异。

AI大潮,再次把一个真相冲上台面:实践伦理学上,大宗教是专业的,阿莫迪的手下们只算票友。不要拿自己的玩票爱好,去挑战梵蒂冈的专业。

本文来自转载字母AI ,观点仅代表作者本人,发现AI平台仅提供信息存储空间服务。

如若转载,请联系原作者;如有侵权,请联系编辑删除。

微信扫一扫

微信扫一扫