OpenClaw 的专属 Computer Use 工具 Peekaboo v3 正式回归,并在发布后高频更新。它补上了 OpenClaw 最缺的一环,让 AI 不只会回消息,还能看屏幕、点按钮、操作真实桌面。

OpenClaw 终于要长出眼和手了!

https://x.com/steipete/status/2053114837698249190

过去几个月,OpenClaw 的热度像一锅刚烧开的水,先是咕嘟咕嘟冒泡,随后逐渐归于平稳。

项目跑起来了,用户开始上手,讨论也从「这是什么」变成「它还能做什么」。

这时,一个被搁在旁边的老问题重新浮上来。

AI 能接消息,能理解指令,能调用工具,下一步总得碰一碰真实世界。

桌面上的按钮、菜单、弹窗、输入框,才是多数工作的最后一公里。

一个 Agent 如果只能在聊天框里给建议,多少像坐在副驾驶上指路,嘴上懂路,手上碰不到方向盘。

Peekaboo 就是在这个时候回来的。

这个名字本身就有点俏皮。Peekaboo 是「躲猫猫」的意思。

电脑界面确实天天跟自动化躲猫猫。

按钮躲在弹窗里,菜单躲在系统栏里,窗口一动坐标全变,焦点一跑输入落空。

人类会凭直觉修正,AI 只能靠一套更靠谱的眼睛和手。

如今,Peekaboo 要补上的正是这套眼睛和手。

从停更到一日三更

Peekaboo 从去年年末发布 v3.0.0-beta 3 后,开始停更。

之后,Peter 将主要精力转向 OpenClaw。

可以理解,OpenClaw 本身就是一张更大的网,要接消息平台,要做网关,要处理本地运行,要支撑 Agent 调度,还要让普通用户装得上、跑得稳、用得明白。

于是 Peekaboo 暂时退到幕后。

变化发生在最近两周。

v3.0.0-beta 4 先出来试水。

就在前天,正式版 v3.0.0 发布。

正式版落地之后,更新节奏开始狂飙,今天一日三更,v3.1.0、v3.1.1、v3.1.2 接连推出。

这种更新密度一般只有两种可能。

一种是出现了重大 Bug,维护者正端着灭火器忙着救火。

另一种是方向终于对齐,积累已久的东西开始往外倾泻。

Peekaboo 这次更接近后者。

过去几个月,OpenClaw 把渠道、网关、Agent 的外壳先搭起来了。

现在,项目开始补最重要的课。

Peekaboo 到底在补什么

对普通用户来说,Peekaboo 最好理解成一套 macOS 自动化工具。

它能截图,能识别窗口,能读 UI 元素,能找按钮,能点、能打字、能滚动、能切应用、能操作菜单。

传统脚本最怕环境变化。

按钮位置换一下,窗口遮一下,弹窗突然出现,脚本就像踩空楼梯,啪一下摔进错误分支。

Agent 更麻烦,因为它要边看边想边操作,任何一步看错、点错、等错,后面都会一路歪下去。

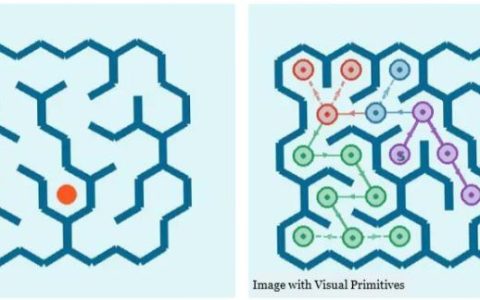

Peekaboo 的价值,是把桌面变成 Agent 能理解的工作场域。

它不只是截一张图给模型看,还要把图里的控件、窗口、文本、按钮关系整理出来,形成可追踪、可复盘、可继续操作的现场记录。

AI 看到的不再只是一片像素,而是一张带结构的桌面地图。

这就像给一个会读菜谱的人配上厨房灯、砧板和锅铲。没有这些东西,厨艺只能停在嘴上。加上这些东西,才有可能开火。

为什么现在才变得关键

Peekaboo 并非横空出世。

它早在去年6月就已上线初版,问题是过去的模型能力还没完全到位。

视觉模型能看图,但未必能稳定理解复杂界面。

Computer-Use 能操作,但经常像第一次摸触控板的人,动作大,心里虚,偶尔还会把浏览器当滑板。

最近的变化在于,模型视觉能力和 Computer-Use 能力都过了一个临界点。

单项进步看起来只是多识别一点、多点准一点、多理解一步,叠起来之后,体验会发生质变。

Agent 不再只是偶尔能演示一下,而是开始接近可持续跑流程的状态。

这时,底层自动化工具的价值被放大。

模型再聪明,也需要稳定输入和稳定执行。

没有 Peekaboo 这样的桥,AI 对桌面的理解就容易停在截图问答。

它能说出屏幕上有什么,却不一定能可靠地完成下一步。

Peekaboo 做的事情,就是把「看见」和「动手」接到一起。

OpenClaw 为什么需要它

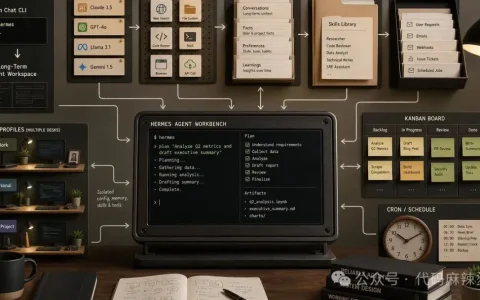

OpenClaw 最初打动人的地方,是把 Agent 放进各种消息渠道。

用户可以从 Telegram、Slack、iMessage、WhatsApp 一类入口发起任务。

这个设计抓住了一个现实问题——人已经懒得为每个 AI 打开一个新网页,也不想在不同工具之间来回搬运上下文。

最顺手的入口,往往就是聊天窗口。

可聊天窗口只是入口。真正的工作场景常常在电脑里。

要处理一个网页后台,要检查一个本地应用,要跑一个模拟器,要填一个表单,要点一个配置项,要看一张报错截图。

OpenClaw 可以把任务接进来,Agent 可以想出步骤,但如果没有能操作屏幕的本地层,它最终还是要把步骤发回给人,让人自己动手。

这就尴尬了。

用户叫来一个助手,最后助手递过来一张待办清单。

Peekaboo 接入之后,OpenClaw 的角色开始变化。

它不再只是多渠道消息网关,也不只是 Agent 的调度台。

它有机会成为一个能在本机环境里真正办事的系统。

一句话概括,OpenClaw 管「谁来找我」「要做什么」「交给哪个 Agent」,Peekaboo 管「屏幕上有什么」「按钮在哪里」「这一刀该往哪儿落」。

开发工具,潜力巨大

社区里已经有人用 Peekaboo 在浏览器里驱动远程 iOS 模拟器。

流程大概是,先让 Peekaboo 分析一张移动应用截图,识别出它是 Little Vault 的欢迎页,页面上有应用 Logo、标题、关于私人记忆的标语、创建 Vault 的主按钮、登录入口,以及右上角的语言选择器。

随后注册这个屏幕,点击 Create Your Vault,等待界面变化,再截图,继续进行探索。

这段演示有意思,因为它展示的并非单纯「AI 看懂一张图」。真正关键的是后半段。

看懂之后,它要把屏幕注册为一个状态,要选择目标,要执行点击,要等待反馈,要根据新截图继续走。

这里面每一步都可能出错,每一步也都可以被记录下来。

这才是 Agent 从玩具走向工具的分界线。

Peekaboo 把这些动作变得可观察、可复盘、可继续。

对 OpenClaw 来说,这等于让远程指令和本地执行之间出现了一条可铺设的轨道。

Peter 忙着更新些什么

这几天的更新看起来有些工程琐碎,比如模型目录、工具 schema、打包产物、版本标记、捕获路径、daemon 调度。

这些词放进发布公告里不一定吸睛,却正是 Agent 产品能不能跑起来的地基。

AI 工具最怕一种场景——演示时行云流水,用户一装就各种权限、路径、模型、窗口、截图、输入法、延迟问题接连冒头。

最后用户也只能得出结论——未来确实来了,就是还没到自己电脑上。

Peekaboo 的连续更新,在修的就是这类问题。

它要让 CLI、MCP、桌面应用、远程 Agent、不同模型之间尽量减小摩擦。

它要让一次截图、一次点击、一次窗口选择都更接近可预期。

这里没有神迹,只有大量脏活。脏活做得越多,用户越少感知到它。

好工具的最高境界往往是没存在感。按钮该点就点,窗口该找就找,任务该继续就继续。

Peekaboo 现在就在往这个方向补课。

它让 OpenClaw 从会聊天变成会干活

OpenClaw 过去解决的是连接问题。

人从哪里发消息,消息怎么进来,Agent 怎么处理,结果怎么回去。

Peekaboo 解决的是执行问题。Agent 接到任务以后,能不能看到真实桌面,能不能找到可操作对象,能不能一步步推进。

这两个问题合在一起,才接近普通人想象中的 AI 助手。

加上 Peekaboo,OpenClaw 才开始像值班的工程师,能登录机器、看屏幕、查问题、点配置、跑流程,让人愿意把事托付出去。

这也是 Peekaboo 对 OpenClaw 的真正意义。

它把 OpenClaw 从消息系统往操作系统的边缘推了一步。

再往前走,OpenClaw 就不只是 AI 的入口,而可能成为 AI 操作个人电脑和个人工作流的本地控制层。

参考资料:

https://peekaboo.sh

https://github.com/openclaw/Peekaboo

本文来自转载新智元 ,不代表发现AI立场,如若转载,请联系原作者;如有侵权,请联系编辑删除。

微信扫一扫

微信扫一扫