CLI命令行工具正在成为2026年AI生态中最重要的基础设施趋势之一。飞书、Google、Stripe、ElevenLabs、网易云音乐——这些看似毫不相关的公司,在过去数月内不约而同发布了面向AI的CLI工具。

下面我将从底层逻辑出发,系统解释为什么CLI是当下AI时代效率最高的能力分发方式,新旧两代CLI的设计哲学差异,以及CLI如何将MCP、Skills、Plugin三种能力一体打包,成为AI能力扩展的事实标准。

为什么飞书、Google、Stripe在2026年同时发布CLI工具?

2026年CLI工具集体爆发的根本原因,是AI主导的操作方式与GUI图形界面之间出现了结构性摩擦。 当AI成为工具的主要操作者,原本为人类眼睛和手指设计的界面,正在变成AI操作的障碍。

AI研究者Andrej Karpathy在一篇记录用AI构建应用的文章中,提供了最直接的第一手观察。他描述自己大部分时间不是在写代码,而是在浏览器标签之间反复跳转——配API Key、改DNS、填环境变量。他的结论是:

“你的服务应该有一个CLI工具。不要让开发者去访问、查看或点击。直接指示和赋能他们的AI。”

这句话的核心逻辑在于:GUI是为视觉系统设计的,AI没有眼睛;CLI是纯文字的,AI天生生活在这个世界里。 当工具提供方意识到自己的主要用户正在从”人类点击者”变为”AI调用者”,发布CLI工具成了顺理成章的选择。

CLI到底是什么?GUI和CLI的本质区别在哪里?

CLI(Command Line Interface,命令行界面)的核心定义是:通过纯文本指令完成操作,而非通过图形界面点击按钮或菜单。 这个定义看起来简单,却是理解CLI与AI适配关系的基础。

一个最直观的类比:

- • GUI(图形界面)= 去餐厅,看菜单,指给服务员”我要这个”

- • CLI(命令行)= 直接对厨房喊”宫保鸡丁,少油,多辣”

结果相同,但CLI更精确、更容易被自动化,也更容易被程序(或AI)操作。

为什么AI天生在CLI世界里运作,而不是GUI?

AI大模型的底层机制是”token序列输入,token序列输出”——本质是纯文本交互。 GUI界面为人类视觉系统设计,需要额外的图像识别和元素定位层(即Computer Use类能力),成本高且不稳定。CLI是纯文本的,与AI的输入输出格式完全一致,不需要任何额外转换层。

以视频压缩为例:

- • GUI方式:打开Premiere,在界面中找导出按钮,选择格式,配置参数,点击渲染——AI需要逐步解析界面元素

- • CLI方式:直接执行

ffmpeg -i input.mp4 -crf 28 output.mp4,一行命令完成——AI原生支持

ffmpeg:开源音视频处理工具,几乎是视频处理的行业标准。通过

brew install ffmpeg即可安装,AI训练数据中已有大量用法示例,无需额外说明书即可使用。

核心结论:人类没有重新爱上命令行。是AI原本就生活在命令行里,大公司只是顺应了这个事实。

AI的实际能力边界在哪里?工具与上下文如何共同决定AI能做什么?

AI的实际能力 = 它能调用的工具 + 它拿到的上下文(说明书)。 这个公式是理解AI能力边界最简洁的框架。

很多人把AI想象成全知全能的系统。更准确的比喻是:一个极其聪明的新员工,学习速度快,但需要两样东西才能真正干活——工具和使用说明书。

- • 装了ffmpeg,AI能处理视频

- • 装了飞书CLI,AI能查日程、发消息

- • 装了Google Workspace CLI,AI能管Gmail和云盘

- • 没装?”不好意思,这个我做不了。”

为什么新工具必须提供显式的Skills说明书?

工具的历史长度直接决定AI的先验知识量:

| 工具 | 发布年份 | AI是否需要显式说明书 | 原因 |

|---|---|---|---|

| ffmpeg | 2000年 | 不需要 | 训练数据中已有大量用法记录 |

| curl / jq | 1997 / 1988年 | 不需要 | 同上,经典工具覆盖充分 |

| 飞书CLI | 2026年 | 必须提供 | 发布时间晚于AI训练数据截止点 |

| ElevenLabs CLI | 2026年 | 必须提供 | 同上 |

飞书CLI是2026年新发布的工具,AI训练数据里完全没有相关内容。不提供说明书,AI不知道这个工具的存在,更无从调用。

因此,新一代CLI工具普遍自带”Skills文件”——一种Markdown格式的使用说明书,告诉AI这个工具能做什么、命令格式是什么、典型场景有哪些。

这里有一个重要推论:工具的发布速度永远快于AI训练数据的更新速度。随着AI工具层的持续爆发,Skills文件的重要性只会越来越高。

新一代CLI和传统CLI有什么本质区别?”为AI设计”意味着哪些具体改变?

新一代CLI从设计之初就假设调用者可能是AI,而非人类开发者——这一根本性设计哲学差异,导致两代CLI在几乎所有细节上产生了分歧。

传统CLI与新一代AI原生CLI的核心设计差异

| 设计维度 | 传统CLI(ffmpeg、curl、jq) | 新一代AI原生CLI(飞书CLI、Google Workspace CLI) |

|---|---|---|

| 目标用户 | 人类开发者 | AI + 人类开发者 |

| 输出格式 | 人类可读的彩色文字 | JSON格式,AI可直接解析 |

| 交互方式 | 遇到选项弹出交互式菜单 | 所有参数通过命令行一次性传入,不弹菜单 |

| 自我描述能力 | 依赖静态 --help 文档 |

支持AI动态查询命令列表和参数要求 |

| 预览执行 | 无 | 支持 --dry-run,AI执行前可预览将发生什么 |

| AI说明书 | 无(依赖模型先验知识) | 自带Skills文件 |

| 上下文控制 | 无 | Skills文件精准控制大小(Google Workspace CLI平均1.6KB) |

新一代CLI在实际场景中如何工作?

以飞书CLI为例:安装完成后提供 200多条命令,覆盖日历、消息、文档、任务、邮箱等11个功能领域。

- • 用户说”帮我看看明天有什么安排” → AI调用

lark-cli calendar +agenda - • 用户说”给张三发条消息说会议改到三点” → AI调用对应消息命令

- • 整个过程无需打开飞书App,无需任何界面点击

Google Workspace CLI更进一步:一条命令即可启动内置MCP服务,让AI通过标准协议统一操作Gmail、Google Drive、Google Calendar,实现跨产品线的一体化AI操作层。

MCP(Model Context Protocol):AI与外部服务之间的标准通信协议,类似AI世界的USB接口——任何支持MCP的AI都可以通过统一接口调用支持MCP的服务,无需为每个AI平台单独适配。

CLI为什么能同时打包MCP、Skills和Plugin三种能力?跨平台通用AI插件的逻辑是什么?

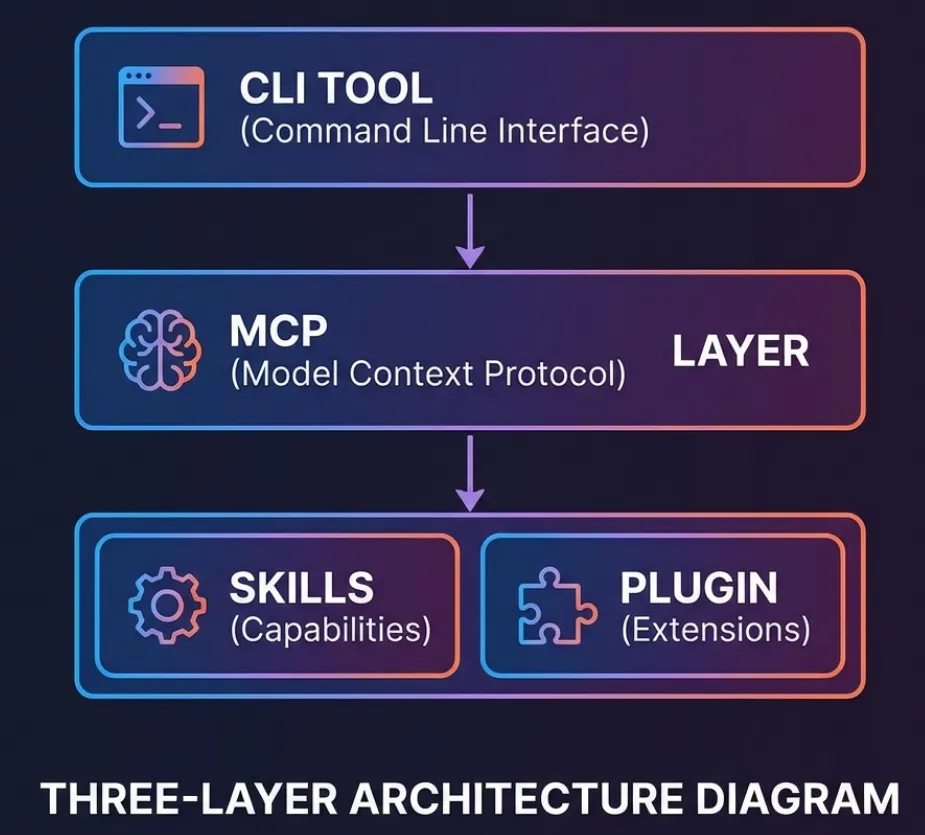

新一代CLI工具的核心优势在于:它同时承担了执行层(CLI命令)、通信协议层(MCP)和说明书层(Skills)三个角色——一个工具,就是一个完整的AI能力扩展单元。 这使其事实上超越了传统Plugin的能力边界。

AI工具生态中,三个概念曾长期并行竞争:

| 概念 | 定义 | 类比 |

|---|---|---|

| MCP | AI与外部服务之间的标准通信协议 | AI世界的USB接口 |

| Skills | 告诉AI”这个工具怎么用”的说明书 | 工具的操作手册 |

| Plugin | 把工具、协议、说明书打包的可安装扩展 | 手机上的App |

新一代CLI的做法是:把这三样全打包进一个工具里。

以Google Workspace CLI为例的三层架构:

- 1. CLI命令 → 提供本地执行能力

- 2. 内置MCP服务 → 提供标准通信协议

- 3. 自带Skills文件 → 充当AI使用说明书

飞书CLI、Stripe CLI、ElevenLabs CLI全部采用同一模式。一个CLI工具装下去,执行能力、通信协议、使用说明一次性到位。

CLI相比传统Plugin有哪些结构性优势?

| 对比维度 | 传统Platform Plugin | 新一代CLI |

|---|---|---|

| 平台绑定 | 只能在特定平台使用(如Claude Code专属Plugin仅在Claude Code中可用) | 跨平台通用,Claude Code、Cursor、Gemini CLI均可调用 |

| 模型绑定 | 绑定特定AI模型或平台 | 模型无关,不关心调用者是Claude、DeepSeek还是Qwen |

| 发布流程 | 需经平台审核,周期长 | 发布到npm即上线,等同于发布网站 |

| 人机兼容 | 仅AI工作流可用 | 人和AI都能使用,开发者维护动力更强 |

| 工具组合 | Plugin之间相互隔离,无标准组合方式 | 支持Shell管道(如 gws gmail +triage | jq '.messages[]') |

在国内场景下,跨平台和模型无关的特性尤为重要:今天接Claude,明天换DeepSeek,后天试Qwen,已安装的CLI工具无需重新配置,能力始终有效。

Shell管道:Unix系统几十年前设计的特性,允许将一个命令的输出直接作为另一个命令的输入。这个上世纪的设计,在AI时代意外地变得极有价值——它赋予了CLI工具之间自由组合的能力,而Plugin之间无法做到这一点。

npm:开发者生态的软件分发平台,大量命令行工具通过它发布安装。运行

npm install -g 工具名即可安装。

“新一代CLI工具三层架构:执行层、协议层、说明书层”

CLI接入AI有哪些真实的风险和坑?安全缺陷与三大实战问题的完整分析

CLI最大的结构性缺陷是安全权限控制粒度不足,这是目前整个CLI生态最需要正视的问题。 在列举所有优势之后,必须直接面对这个局限。

安全风险:CLI的权限模型与沙箱机制的差距

Plugin在平台沙箱中运行,具有声明式权限控制(类似手机App的权限弹窗——”是否允许访问通讯录?”)。CLI是直接执行Shell命令,AI一旦能运行某个CLI工具,就能以该工具的系统身份执行几乎任何操作,没有”只读不写”的细粒度访问控制。

当前的补救方案(--dry-run 预览执行、操作前弹窗确认)与平台级权限框架相比,差距仍然明显。这是CLI大规模进入企业生产环境之前必须解决的问题。

沙箱:一种隔离运行机制,程序只能执行被明确授权的操作,超出范围的操作会被拦截,即使出错也不影响系统其他部分。类似手机App的权限申请机制。

三大高频实战坑点

在实际将多个CLI工具接入AI工作流的过程中,有三类问题反复出现:

| 问题类型 | 具体表现 | 根本原因 | 已知解决方案 |

|---|---|---|---|

| 上下文撑爆 | Skills文件过大,占满AI上下文窗口,推理质量明显下降 | 工具开发者缺乏控制说明书体积的意识 | 参考Google Workspace CLI:Skills文件平均控制在1.6KB,精准提供AI所需信息 |

| 交互式菜单卡死 | CLI弹出 ? Which environment? 选择菜单,AI无法处理交互式输入,直接卡住 |

工具按人类交互习惯设计,未适配AI无GUI的运作方式 | 增加 --no-interactive 参数强制非交互模式(Stripe CLI已修复此问题) |

| 输出过长淹没信息 | 单次查询返回数万字符JSON,有效信息被大量噪音淹没 | 默认返回全量数据,未针对AI使用场景做字段过滤 | 使用field masks控制返回字段(Google Workspace CLI已实现,但跟进者稀少) |

Field masks:调用API时指定只返回特定字段的机制。查邮件只需要主题和发件人时,不返回完整正文,有效减少无效上下文占用,提升AI推理效率。

这三个问题有一个共同根源:”为AI设计”和”在AI中验证”是两件完全不同的事。 就像移动端适配——设计稿上响应式正常,真机上按钮根本点不到。自称”AI友好”的工具,有多少经过了在真实AI工作流中的系统性验证?

为什么要让AI管理自己的工具?从传统软件思路到AI原生思路的实战转变

让AI管理自己的工具,比用代码写死安装逻辑靠谱得多。 这个结论来自一次具体的工程思路转变。

传统思路 vs AI原生思路的实际对比

在构建CLI工具管理功能时,最初的标准做法是:

- 1. 写代码嗅探用户系统已安装的CLI工具列表

- 2. 构建UI界面让用户在图形界面上管理工具

- 3. 写版本检测逻辑处理更新

这是标准软件工程路径,但存在一个根本性瓶颈:每个CLI工具的安装方式不同,权限要求不同,依赖项不同,报错类型也不同。用代码穷举所有边界情况是写不完的。

AI原生思路的转变只需要一个问题:产品里已经有AI了,为什么要绕过它?

- • 安装工具:直接通过对话让AI执行。AI读取

--help,判断操作系统,处理权限错误,引导完成认证配置。遇到报错,AI读取错误信息自主判断——是否需要sudo?是否需要先安装依赖? - • 注册工具能力:提供提示词模板,让AI读完

--help后自动生成结构化描述,包括工具能做什么、命令格式、典型场景

sudo:macOS/Linux系统上临时获取管理员权限的命令。安装某些工具需要写入系统保护目录,普通权限不够时使用。

如何评估一个CLI工具是否真正对AI友好?5维兼容度评分框架

| 评分维度 | 具体评估标准 | 重要程度 |

|---|---|---|

| 为AI设计 | 是否有非交互模式、参数化操作、无弹窗交互 | 高 |

| 结构化输出 | 输出是否为JSON或其他AI可直接解析的格式 | 高 |

| 自查能力 | AI能否动态查询工具的命令列表和参数说明 | 中 |

| 预览支持 | 是否有 --dry-run 或等效预览机制 |

中 |

| 上下文控制 | Skills文件是否合理控制体积,输出是否支持字段过滤 | 高 |

这个评分框架的核心意义在于:呼吁工具开发者在设计阶段就开始思考”我的CLI对AI友好吗?”而不是在AI接入失败后才来修补。

AI工具链目前还缺什么?发现、认证、安装三大基础设施空白

CLI正在成为AI能力扩展的事实标准基础设施,但这个生态有三个明显的结构性空白:发现机制、统一认证、AI友好的安装体验。 谁填补这三个空白,谁就可能成为AI时代的npm。

空白一:发现机制——你怎么知道某个CLI工具的存在?

目前,AI工具CLI的传播渠道基本是口口相传——关注了特定的技术账号或博客,才能知道某个CLI工具的存在。npm和GitHub最具条件构建一个AI工具的App Store,但这不在它们目前的产品优先级内。发现层是当前最大的空白,也是最大的机会所在。

空白二:认证统一——五个工具,五次独立登录

飞书、Google、Stripe、ElevenLabs各有一套完全不同的认证流程。装五个CLI工具,需要完成五次不同的登录配置。对熟悉命令行的开发者是麻烦,对普通用户是真实的摩擦壁垒。统一的CLI认证管理层目前尚不存在——类似密码管理器,但专为CLI工具设计。

空白三:安装体验——为人设计的包管理器遇到了AI操作者

npm和Homebrew是十几年前设计的,默认使用者是懂命令行的人类开发者。”权限被拒绝——去Stack Overflow搜一下”这种解决路径,对AI来说根本不可用。

AI需要结构化的、可自主处理的安装失败信息,而不是为人类设计的模糊报错提示。 现有包管理器在这方面几乎没有针对AI操作者的适配。

Homebrew:macOS上最流行的命令行工具包管理器,通过

brew install 工具名安装,默认面向有终端使用经验的开发者。

行业不缺工具,不缺协议,也不缺说明书。缺的是让这三样东西被发现、被安装、被信任的那一层基础设施。谁做出来这个,谁就是AI时代的npm。

总结:CLI为什么是AI时代当下最务实的能力分发方式?

CLI在2026年集体爆发的原因,是它同时解决了AI工具调用的三个核心问题:执行能力、通信协议、使用说明——三者一体打包,跨平台通用,模型无关。 这是它在当前时间节点相对于任何其他方案的核心优势。

- • 每多装一个对AI友好的CLI工具,你的AI就多一项真实能力

- • 每减少一分多余的上下文噪音,你的AI推理就清晰一分

我们正处在新旧交替的混乱阶段:旧的GUI交互范式、旧的Plugin生态、旧的包管理器,与新的AI原生工具链交织在一起。CLI不是终态——安全权限框架、发现机制、统一认证,这些问题都还没有完整的答案。

但在这些问题被系统性解决之前,CLI是当下最务实的选择:已经有Google、飞书、Stripe这样级别的公司在这条路上押注,生态正在快速成形。谁构建出AI工具的发现层基础设施,谁就是AI时代的npm。这场竞赛已经开始。

常见问题(FAQ)

Q1:CLI工具和MCP服务器有什么区别?可以互相替代吗?

A:两者不完全可以替代。CLI工具是本地执行层,安装在用户系统上,通过Shell命令调用;MCP服务器是通信协议层,定义AI与外部服务如何通信。新一代CLI工具(如Google Workspace CLI)往往内置MCP服务,将两者打包在一起——安装CLI的同时获得MCP通信能力。单独的MCP服务器需要额外配置,而CLI工具可以独立工作,并兼容多种AI平台。

Q2:Skills文件和系统提示词(System Prompt)有什么关系?

A:Skills文件是CLI工具自带的Markdown格式说明书,描述工具有哪些命令、参数格式、使用场景,在工具被调用时加载到AI上下文中。System Prompt是整个AI会话的全局配置,层级更高。当Skills文件体积过大时,会占用本应留给System Prompt和对话历史的上下文空间,影响AI整体推理质量——这正是Google Workspace CLI将Skills文件控制在1.6KB的原因。

Q3:为什么说CLI是”模型无关”的?对国内用户有什么实际意义?

A:CLI工具不关心调用它的是哪个AI模型——无论是Claude、GPT-4、DeepSeek还是Qwen,只要AI能执行Shell命令,就能使用已安装的CLI工具。对国内用户,这意味着AI基础模型的切换(出于成本、合规或访问限制等原因)不会导致已安装的工具能力失效。相比之下,某些Platform Plugin只在特定平台可用,换了平台就需要重新配置。

Q4:普通用户(非开发者)能使用这些CLI工具吗?

A:当前安装和配置门槛仍然较高,主要面向有命令行基础的开发者。npm安装、认证配置、路径设置——对非技术用户不友好。随着AI引导安装流程的成熟(即通过对话完成整个安装过程),这个门槛有望降低。但在现阶段,没有基本终端操作经验的用户使用这些工具仍有明显障碍。

Q5:如何快速判断一个CLI工具是否真正适合AI调用?

A:参考本文提出的5维Agent兼容度评分,重点看三个高权重维度:(1)是否支持非交互模式(无弹窗菜单);(2)输出是否为结构化JSON;(3)Skills文件体积是否合理控制(参考值:1-3KB)。如果这三点都满足,该工具在AI工作流中通常具有较好的可靠性。Google Workspace CLI是目前五个维度表现最均衡的参考基准。

Q6:为什么Shell管道在AI时代特别重要?

A:Shell管道(命令A | 命令B)允许将一个命令的输出直接作为另一个命令的输入,实现工具间的自由组合。这个设计使CLI工具天然具备可组合性——AI可以将多个CLI工具串联成复杂的自动化流程,而这是Plugin架构做不到的(Plugin之间相互隔离,没有标准的组合机制)。在AI主导的自动化场景中,工具的可组合性直接决定了复杂任务的可执行性上限。

本文来自转载羊cc ,观点仅代表作者本人,发现AI平台仅提供信息存储空间服务。

如若转载,请联系原作者;如有侵权,请联系编辑删除。

微信扫一扫

微信扫一扫