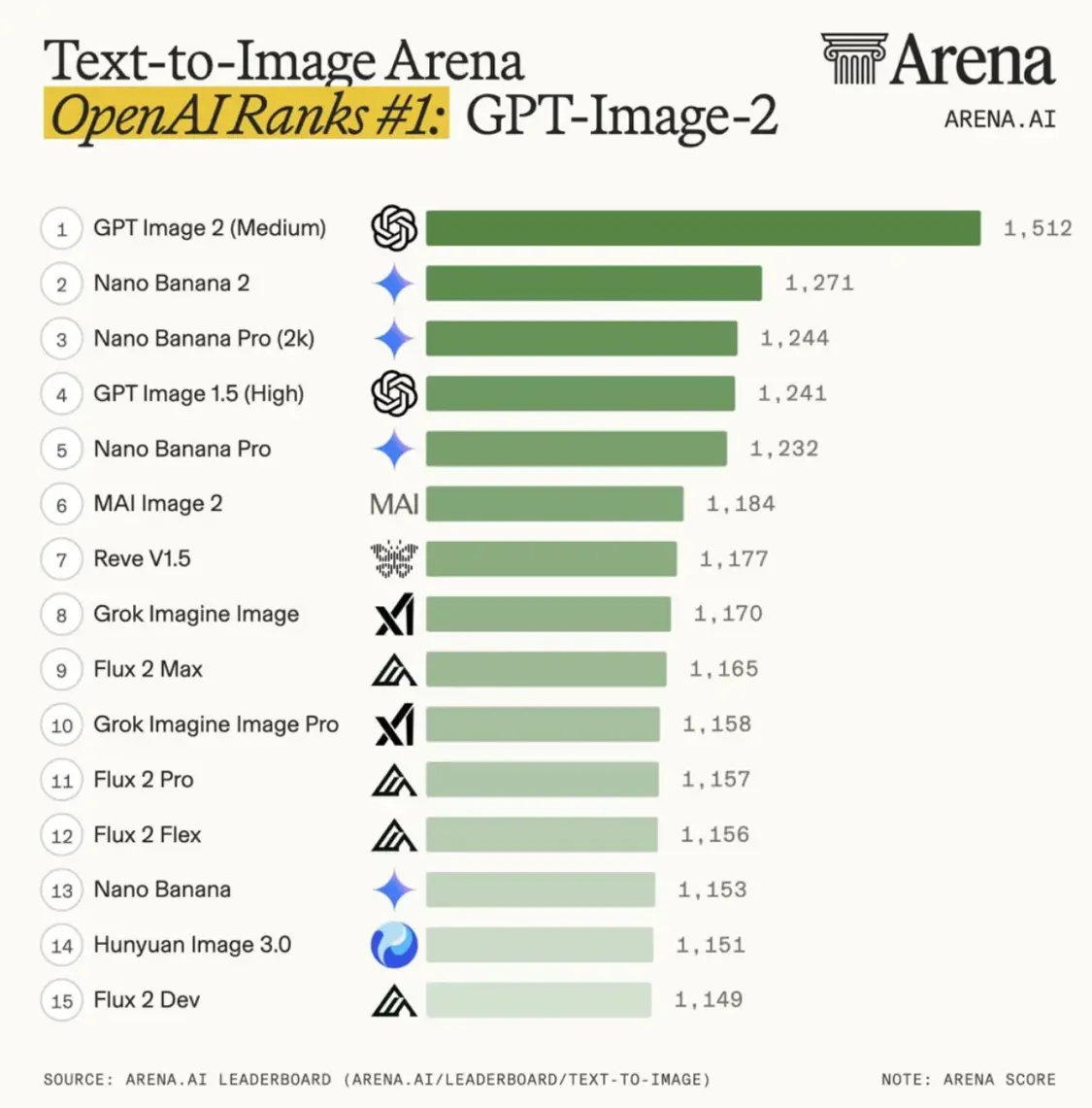

GPT Image 2 正式上线后,AI 图像生成领域现在只剩两个段位:GPT Image 2,以及其它。

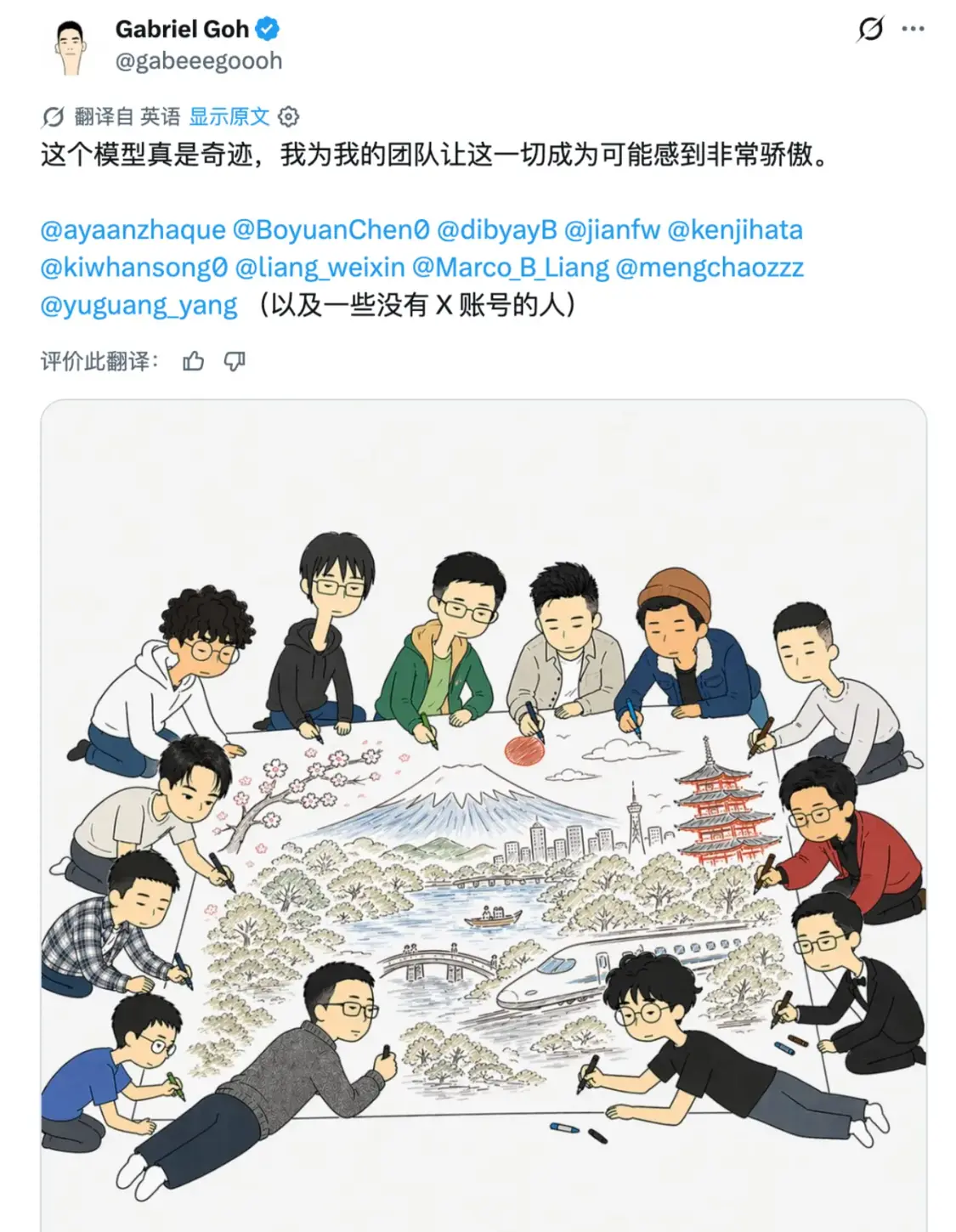

在大模型竞技场中,GPT Image 2 以 241 分的绝对优势遥遥领先,但比起跑分,这份研发名单其实更有看头。

搞出这个模型的 OpenAI 核心团队,满打满算只有 13 个人。

并且华人还占据了团队的半壁江山。仔细看他们的履历,你会发现不少人来 OpenAI 之前,就已经在中国某所大学、某个实验室甚至科研夏令营里打过照面了。

AI 圈就是个巨大的熟人局。

流水的硅谷大厂,铁打的师徒局

陈博远是 GPT Image 2 的绝对核心成员,而他的成长却是华人学术「传帮带」的缩影。

高中时,陈博远在无锡参加科研夏令营,当时他未学过编程,在此认识了后来成为 Google DeepMind 资深研究员的华人学者夏斐。夏斐向他介绍深度学习,成为他进入 AI 领域的引路人。

两人此后一直保持联系。本科阶段,陈博远就读于 UC Berkeley 计算机科学与数学专业,进入 EECS 荣誉班,GPA 达 3.96,师从 Pieter Abbeel 从事相关研究,还于 2017 年创办机器人教育公司,经营至 2020 年。

MIT 读博第一年,陈博远因无论文产出陷入困境,夏斐提供关键支持,协助他发表第一篇有影响力的论文 NLMap。夏斐还两次邀请他到 DeepMind 实习,2023 年实习期间,他主导搭建多模态大语言模型数据合成管线,其总结的指令微调技术被用于 Gemini 2.0 研发。

带着这些积累,陈博远在 2025 年 6 月加入 OpenAI。除此之外,他还是 Sora 视频生成团队的成员,身兼数职。

在 MIT 期间,陈博远师从助理教授 Vincent Sitzmann,在计算机科学与人工智能实验室(CSAIL)做世界模型方向的研究。而 Kiwhan Song,就是同一个实验室里、同一个导师带出来的同门师兄弟。

▲

https://kiwhan.dev/

Sitzmann 实验室的核心研究方向是「世界模型」,简单说就是让 AI 通过心理模拟器预判物理世界的变化,而不只是单纯模仿像素。这种研究思路,或许也直接影响了 GPT Image 2 的技术方向。

两人在博士期间多次合作,联合发表了《History-Guided Video Diffusion》和《Large Video Planner》两篇论文,主要探索如何把扩散模型和序列生成结合起来,让模型在生成内容之前,先理清时序和空间上的因果逻辑。

▲

https://arxiv.org/abs/2502.06764

值得一提的是,Kiwhan Song 正是「长脖子」贴纸风格漫画头像的创作者。

除了这两位同门,团队里还有两位华人成员,他们来自工业界积累多年的华人研究员网络。

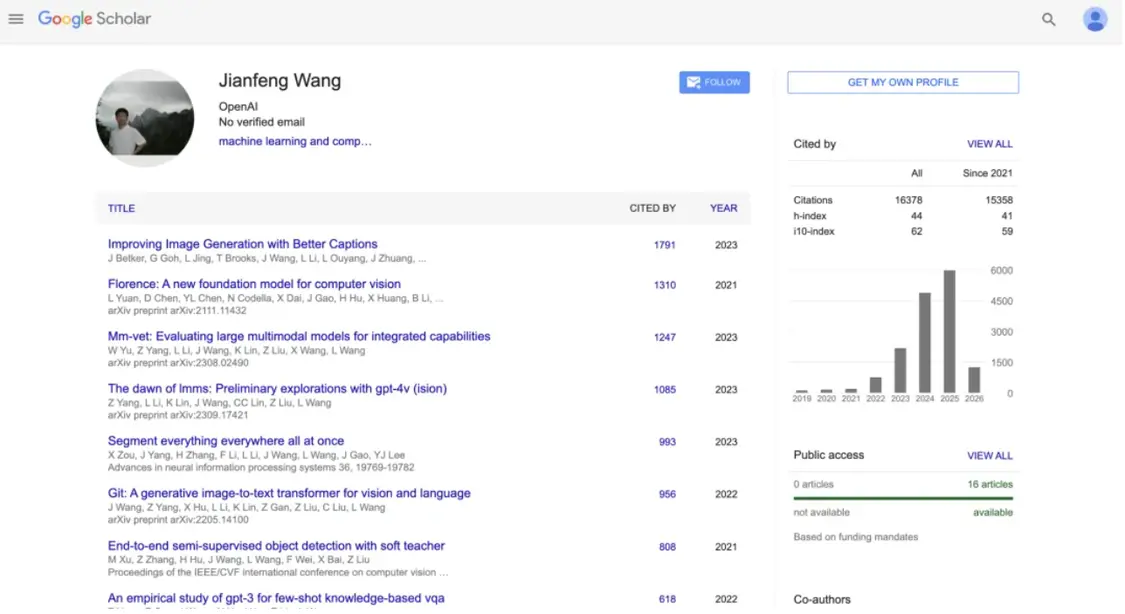

Jianfeng Wang 在微软工作了近 9 年,以首席研究员的身份专注于大规模多模态表示学习,在 DALL-E 3 研发期间,就和 OpenAI 团队有过深入合作。加入 OpenAI 后,他主要负责提升模型的指令遵循能力和对世界知识的理解。

▲

https://scholar.google.com/citations?user=vJWEw\_8AAAAJ&hl=en

Bing Liang 则在谷歌深耕了 5 年多,以高级软件工程师的身份参与了 Imagen 3、Veo 视频模型和 Gemini 多模态系列的核心研发工作,去年 8 月加入 OpenAI,负责图像生成相关的研究。

▲

https://www.linkedin.com/in/bing-liang/

他们带来的不只是自己的个人能力,还有竞争对手多年积累的工程经验,以及曾经踩过的坑,为团队省去了不少弯路。

给天才们搭好戏台子

Weixin Liang 和 Yuguang Yang 是团队里另一个值得关注的组合,两人都毕业于浙江大学竺可桢学院,有着相同的本科背景。

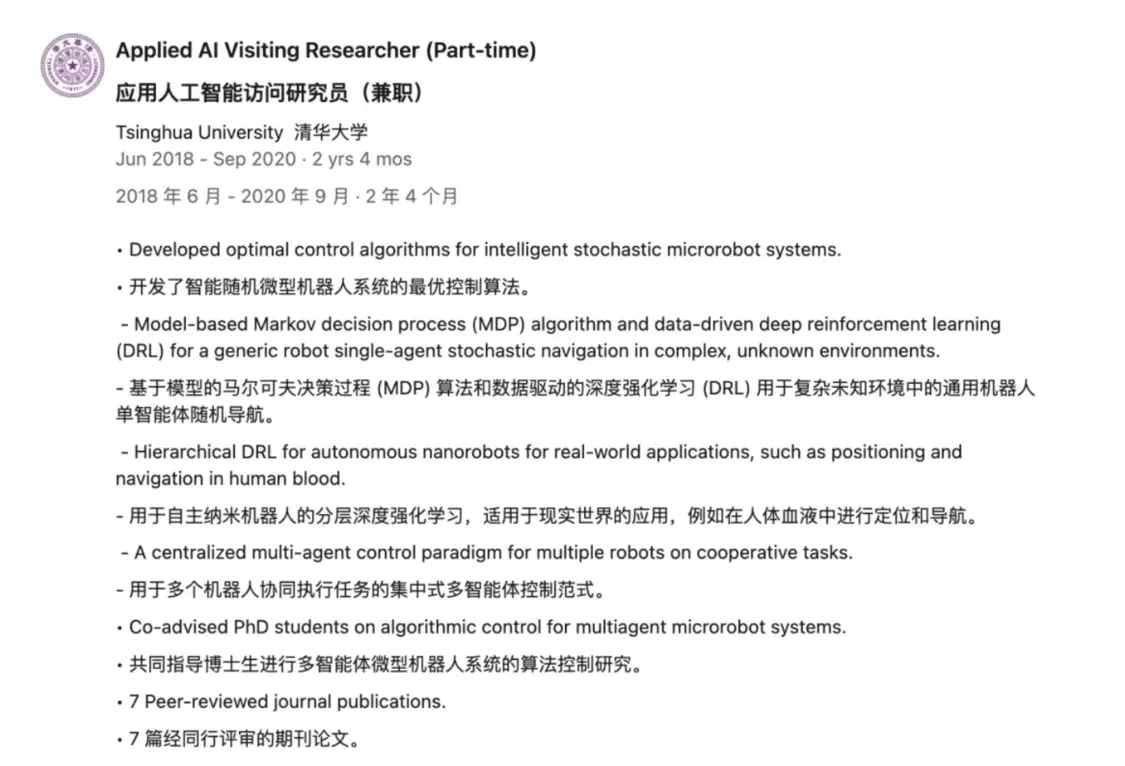

Yuguang Yang 的履历跨度很大。本科时在竺可桢学院学工程,博士阶段则去了约翰斯·霍普金斯大学,攻读计算化学物理与机器学习专业,拿到学位后,先后在亚马逊 Alexa 做语音识别方向的深度学习研究,之后又去了微软 Bing,负责查询理解与大规模检索相关工作。

他还曾在清华大学做过访问研究,研究方向是用于纳米机器人在人体血管中导航的强化学习算法,期间发表了 7 篇同行评审的期刊论文。这种跨学科的积累,在 GPT Image 2 的发布演示中也能直接看到。

和 Yuguang Yang 相比,Weixin Liang 的成长路径更偏向学术。他在斯坦福 AI 实验室(SAIL)攻读博士,期间和 Christopher Manning、Li Fei-Fei、James Zou 等多位知名教授都有过合作。

▲

https://ai.stanford.edu/~wxliang/

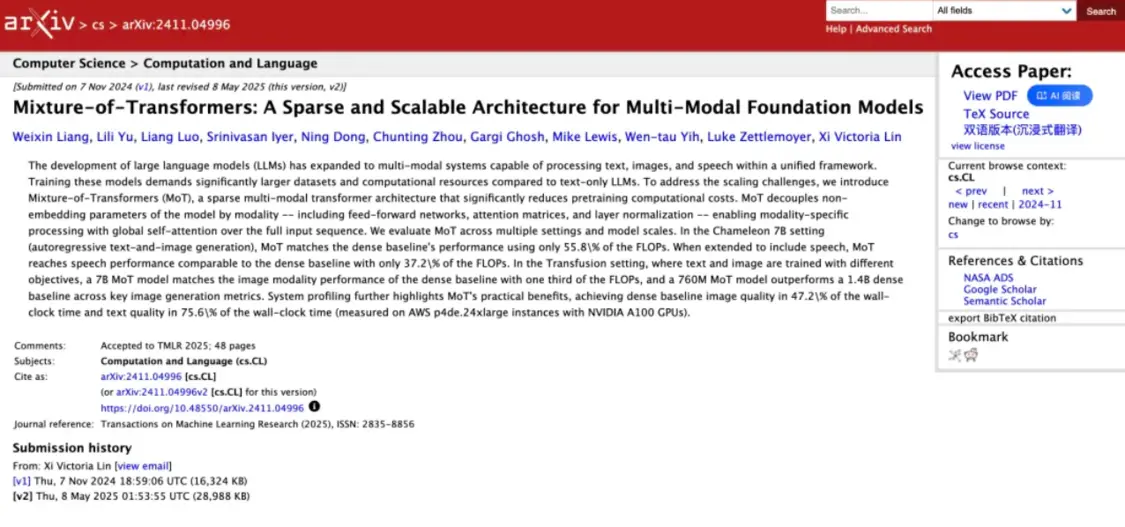

在 Meta 实习期间,他发表了论文《Mixture-of-Transformers(MoT)》,通过引入模态解耦的混合专家模型架构,对 Transformer 的每一个非嵌入参数,包括前馈网络、注意力矩阵和层归一化,都实施了模态感知的稀疏化处理,最终将多模态预训练的计算成本降低了 66%,还在 30B 参数规模下完成了预训练验证。

多模态模型因为要同时处理文本和高分辨率图像,计算量很容易呈指数级增长,而 MoT 凭借模态解耦的注意力机制,在预训练阶段就高效分配了不同模态之间的权重,很好地解决了这个问题。这项研究后来也被称为「推动多模态理解与生成统一的奠基性贡献」,在多模态建模领域引发了大量关注。

▲

https://arxiv.org/abs/2411.04996

近年来,清华姚班、浙大竺可桢学院、中科大学少年班、上海交大等学校的毕业生,已成为 OpenAI、Anthropic、DeepMind、Meta 等海外 AI 实验室的核心力量。

除了上述成员,团队还有几位核心研究者,各自发挥重要作用:

Kenji Hata:斯坦福计算机科学硕士,曾任职于 Google Research。加入 OpenAI 后,参与 4o 图像生成(即 GPT-Image-1)、Sora 2 等多款模型研发,是团队中模型迭代经历最完整的成员之一。

Ayaan Haque:加入 OpenAI 前为 Luma AI 研究员,参与训练视频生成模型 Dream Machine。这段经历让他具备处理高维时序数据的能力,在 OpenAI 主要负责 GPT Image 2 及思考模式研发。

Dibya Bhattacharjee:耶鲁计算机科学本硕,曾在谷歌深耕近 5 年。2024 年 2 月加入 OpenAI 负责图像生成研究,在发布活动中演示模型多规格生成能力,是模型输出格式「开箱即用」的关键成员。

Mengchao Z.:上海交大本科、德克萨斯 A&M 大学硕士,工程背景扎实。加入 OpenAI 前主导大规模推荐系统架构设计,目前负责将模型技术能力转化为可用产品形态。

此外,团队里还有多名成员的身份信息目前暂时无法查询。

师门脉络积累了研究品味,高校背景奠定了基础认知,这种由师门、同窗、前同事织就的人才网络,天然形成了一种极高密度的信任——由于价值观和工程语言的高度统一,创新的磨合成本几乎为零。

如果只是重金挖走一两个陈博远,其实治标不治本。找不到同伴,也就很难复现这种自然涌现的创新。大厂的组织结构决定了层级和目标明确对商业化有利,但对于需要自由探索的基础研究,往往形成了某种约束。

AI 的竞争,归根结底是关于「人」的故事,比起寻找下一个陈博远,我们更需要搭建一个让陈博远们能在本土自然相遇、互相成就的生态。

本文来自转载爱范儿 ,观点仅代表作者本人,发现AI平台仅提供信息存储空间服务。

如若转载,请联系原作者;如有侵权,请联系编辑删除。

微信扫一扫

微信扫一扫