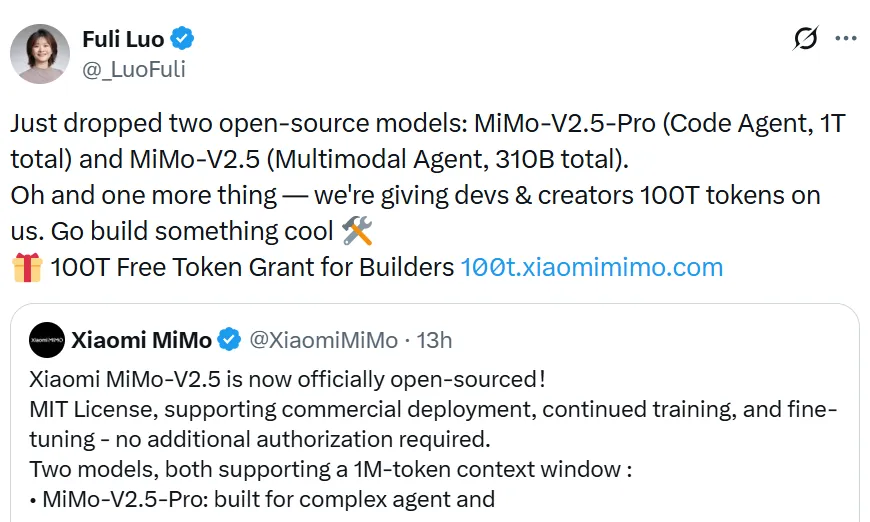

就在公测短短 5 天后,小米罗福莉团队就把 MiMo-V2.5-Pro 和 MiMo-V2.5 两个主力模型权重、tokenizer 全甩到 Hugging Face 上了。

模型开源就算了,小米 MiMo 还开启了一个“Xiaomi MiMo Orbit 百万亿Token 创造者激励计划”,又添了一把火。身为开发者和创作者的大佬们真的都可以去申请试一试!

在 MiMo-V2.5 系列中,MiMo-V2.5-Pro 是专为复杂的 Agent 和编码任务而设计的,总参数 1.02T ,激活参数 42B 。而 MiMo-V2.5 是具有强大 Agent 能力的原生全模态模型,总参数 310B ,激活参数 15B 。

我们先来理解一下通用 Agent 评估基准的三个重要指标:

GDPVal-AA(Elo)考的是Agent能不能干真实世界中专业人士的活,考试范围覆盖44个职业,评估只看实际产出质量并采用Elo评级系统。

τ³-Bench 考的是 Agent 能不能当好真实客服,是否具有长时间对话、多轮对话和遵守策略的能力,评估看的是多次运行下的成功率,更强调可靠性。

ClawEval(pass^3)是2026年才发布的端到端Agent评估基准,考的是Agent 在全程透明和被干扰时完成 300 个真实任务的水平。每一步 Agent 动作都会通过执行轨迹、审计日志、环境快照三重证据记录,实现轨迹感知评分。评估要求在 3 次独立运行中全部通过才算成功。

令人惊叹的是,V2.5-Pro 在 GDPVal-AA(Elo)上拿下 1581,在ClawEval(pass^3)上拿下 63.8,τ³-Bench 上拿下 72.9,稳居开源榜首,和世界顶尖闭源模型进行比较,如Gemini 3.1Pro、GPT-5.4和Claude Opus 4.6,也没在怕的。

同时,V2.5-Pro 的 Token 效率相较 Kimi K2.6 能省 42%,而其编码能力又直逼 DeepSeek V4 Pro,并且成本更低。V2.5的经济效益也很不错。

另外,两款模型的部署非常简单,可以在 Hugging Face 上一键下载,小米与社区合作实现了vLLM和SGLang的当天支持,并且模型原生支持FP8混合精度,量化后哪怕消费级显卡也能处理长上下文任务。

罗福莉关于Agent的见解

在罗福莉和主持人张小珺聊天的开头,她就说道:在过去两个月里,OpenCLaw 的使用是 AI 技术进化的一个巨大分水岭。

罗福莉的 OpenClaw 使用经历

她在一月份刚知道 OpenClaw 时,和大多数人一样,只觉得“ OpenClaw 不过就是 Claude Code 加上一个即时通讯(IM)界面。”不过,到春节期间,有空用了 OpenClaw 之后,她觉得:哇,它非常有自主性,而且很有“灵魂”。而这种温暖感和关怀感得益于 OpenClaw 的很多机制:

比如它有 search.md。再举个最简单的细节,比如它如何感知时间?它在每一轮对话的上下文中都会拼入当前时间。还有一些非常细微的设计,这就是为什么我把它称为“精细编排的上下文”。正因为在这些没人注意的角度上,上下文被安排得非常好。

到了第二天,她和 OpenClaw 就“如何在团队中激发好奇心”或“如何筛选一个有好奇心的人”深入讨论了一个小时,并最终转化成一系列 Skills 。到现在,无论是选人还是团队管理,她都会问 OpenClaw 。她觉得它基本变成了她的数字分身。

第三天,她想到“如果在 Agent 框架下工作,最重要的是如何进行多轮交互”,而这需要模拟用户 Agent,于是就“如何构建一个好的用户 Agent ”,她尝试和 OpenClaw 讨论了一两个小时,结果基本实现了。

她可以将用户 Agent 与她目前的后训练(post-training)框架结合,构建更丰富的智能体场景数据。无论是做有监督微调(SFT)还是强化学习(RL),这个用户 Agent 都非常关键。

她认为她的认知经历了三次转变,“从最初觉得它只是一个有灵魂、有温度的产品设计,进化到它能帮我分担生活或工作,最后甚至推动了我的研究。”每天都给她带来了更多惊喜。

之后,她开始仔细研究为什么 OpenClaw 的框架比 Claude Code 更好。她分析到:

它有一个更持久的记忆系统。这套记忆系统非常耐用,体现在记忆的分层和分级上。我在用 Claude Code 时完全没有这种感觉。再比如,我觉得是多模型的协同利用,这超出了我的想象。例如,用 Claude Code 时,我会默认如果这个模型的视频理解能力不行,我可能得自己给它配一个更好的视频理解模型。但在 OpenClaw,我完全不需要考虑这些,我直接发个视频给它,它会自己想办法找一个视频理解能力强的模型来处理。

她认为,OpenClaw 的核心产品逻辑是,“尽可能通过整套 Agent 编排来弥补模型的短板”。

她和团队还把MiMo V2 Flash 和最近训练的非常小的 3B 端侧模型放到了OpenClaw 里,然而依然能完成那些她认为小模型做不到的事情。所以她第一次感觉到,“原始且复杂的 Agent 框架设计确实能弥补很多模型能力的不足”,而这也是“ OpenClaw 相比 Claude Code 的差异化优势”。

持久化记忆设计

罗福莉认为,一个好的 Agent 框架有一些最基本的特征,比如持久化记忆。

OpenClaw 的设计借鉴了 Claude Code 的记忆系统设计思路。“例如在会话快满时进行压缩,然后存入记忆。任务完成后,根据计划可能还有一些记忆动作,这样可以确保跨会话的上下文共享效果更好。”

但它更多考虑的是如何更好地端到端完成所有任务,以及如何针对当前模型在端到端任务中的短板进行设计,所以出现了持久化记忆的这种设计,后来能通过更好的远程接口来控制。并且,在接下来的两个月里,这些优秀的设计也被 Claude Code 完全吸收了。

她认为,OpenClaw这种新的Agent框架加上中档模型,“可以在 85% 的任务上达到与 Claude Sonnet 同等量级的水平”。

Agent 的“自学习”

罗福莉讲到,Agent 的“自学习”最可能的发生路径是:

模型本身与 Agent 架构需要同步演进。随着模型的进步,无论是通过强化学习还是其他训练方式,它实际上在改变你的整个 Agent 框架。

这包括发送给模型的静态信息,比如记忆、Skill 文件夹,这些在开启新会话时应该传递给模型的信息,这些在训练过程中应该是会改变的。

还有一些动态信息,包括整个 Agent 架构的设计,这非常重要。

针对不同场景,比如用于软件工程的 Claude Code,或者用于金融分析的场景,其 Agent 架构设计都会有所不同。

在提升模型能力的同时,需要提升 Agent 框架对该模型的适配度或泛化能力。

Agent 框架/ Harness

在主持人疑惑 Agent 框架是否为“产品”时,罗福莉给出的答案是:

“产品”可以定义为人机交互时能直接感知到的层面。但 Agent 框架位于定义交互层之前,它定义了你在那个层面如何与模型进行沟通。

小编认为她口中的 Agent 框架就是今年AI圈爆火的 Harness 概念。

她讲到,Agent框架能了解模型能力的优缺点,知道如何更好地调度,比如为了成本优化。这一人与模型之间的中间层可以做得非常厚,而前端UI成为最薄的一层,不再是关键。

她还认为“Claude Code 一直是一个非常复杂的 Agent 框架,只是因为它是个黑盒,所以我们不知道它是如何设计的。OpenClaw 是开源的,所以你知道它是如何设计的,然后你可以去改变它。这种“可改变性”非常非常重要。”

MLA 机制不符合 Agent 的范式

在对话时代,MLA(多头潜在注意力机制)是出色的模型结构,在长文本中它能显著减少 KV Cache。但罗福莉认为,MLA 不符合 Agent 的范式。她给出的理由是:

MLA 的原始设计是为了在当时的 H 系列芯片上实现更好的访存计算比(Memory Access to Calculation ratio),从而打破访存瓶颈,不浪费算力。在这种结构下设计的模型架构,几乎没有发挥空间。

而如果 KV Cache 很重要,同时推理速度也很重要,那能不能用一些推理加速的方法呢?

她想到了MTP(多Token预测)也是一种方法,可以让实际推理速度提升 n 倍。

但 MLA 结构下很难写 MTP,因为 MLA 已经达到了压缩与访存(Memory Bound)的一个完美临界点。如果你再用 MTP(多 Token 预测),你会发现它又会被计算受限(Calculation Bound)卡住。所以现在你看所有 MLA 结构的模型,无论是 GLM 还是 Kimi,我猜他们都没用 MTP,因为在计算受限的情况下用 MTP 并不划算,所以他们的模型会慢一些。

而她和团队选择的解决方式是:利用滑动窗口节省下来的注意力算力去填充 MTP。具体架构创新是:

我们将混合比例推向了极致,全量注意力(Full Attention)和滑动窗口(Sliding Window)层的比例达到了极端的 7:1。这样节省了 KV Cache,所以我们在这一代结构上通过滑动窗口层减少了 KV Cache,使其在处理长文章时更有效,能支持更长的上下文。

这样在实际推理中,访存和计算能达到很好的平衡。同时也兼顾了长文本的成本和推理速度。

参考链接:

https://x.com/_LuoFuli/status/2048851054662762618?s=20

本文来自转载51CTO技术栈 ,不代表发现AI立场,如若转载,请联系原作者;如有侵权,请联系编辑删除。