今年 3 月到 5 月国产模型密集发布,我把当前能力最强的四家国产模型全部接入测了一圈:DeepSeek V4、Kimi K2.6、GLM-5.1、MiniMax M2.7。跑完一圈之后的判断是主力仍然留在 Claude,但有几类任务完全没必要继续用 Claude 来处理。

大文档分析、长程后台任务、批量内容生产,这些场景对模型精度的要求不高,对成本和吞吐的要求很高,正好落在国产模型最有优势的区间。

四家各一句话

先快速做一个横向对比。DeepSeek V4 是唯一没有官方订阅的,只能按 API 计费,但 Flash 档价格只有 Claude 的 1%,100 万 token 上下文是真实可用的——不限速不排队,大陆信用卡直接付。Kimi K2.6 入门 39 元,社区有人拿它连续跑了 13 小时重构金融引擎没停,但工具调用稳定性一般,高峰期容易排队。GLM-5.1 入门 49 元、Pro 149 元,模型本身不错但服务器高峰期经常过载,今年涨价翻了一倍多。MiniMax M2.7 入门 29 元是四家最便宜的,每秒 100 token 也是最快的,文字生成很强但碰到复杂数学会死循环。

作为对比锚点:Claude 海外 Pro 订阅每月 20 美元折合约 144 元,Code 订阅 200 美元折合约 1440 元。

DeepSeek V4

4 月 24 日发布,距离 V3 整整 484 天。

DeepSeek 是四家中唯一没有官方订阅的,所有使用按 API 计费。Flash 档定价输入 1 元、输出 2 元每百万 token,缓存命中时输入降到 0.2 元。按我自己一个月的真实用量算——输入 1 亿 token、输出 3000 万 token——全走 V4-Flash 月成本大约 160 块。同样的量走 Claude Opus 4.7 大约 9000 块(纯 API计费, coding plan 价格当然会便宜)。

100 万 token 的上下文窗口是测试中用得最多的能力,而且是真的 100 万——有些模型标称支持长上下文,实际超过 20 万 token 之后输出质量明显下降(linuxdo 论坛有大量类似反馈),V4 没有这个问题。一份 50 页技术文档整份扔进去做分析,一个 GitHub 仓库的全部代码一次性读完,一份长合同的所有条款不用分段处理。这些场景过去需要切窗口、做检索增强、精心管理上下文长度,在 V4 上直接全量输入即可。

测试期间最舒服的一点是没有限速、没有排队。GLM 和 Kimi 在高峰期经常要等位甚至直接不可用(这一点 linuxdo 社区反馈很多),DeepSeek 测试期间没有碰到过。支付也是大陆信用卡直接结算,不需要折腾外币卡和代理,对国内用户来说基本零摩擦。

V4-Flash 虽然是最便宜的档位,但测试中用来处理大文档和代码库分析,输出质量已经足够。Pro 档能力更强,但目前算力受限吞吐有限,响应速度比 Flash 慢不少,需要等下半年华为昇腾 950 上市后才可能改善。V4 不支持多模态,这是目前最明显的短板。如果想要订阅式体验,目前只能通过阿里云百炼、火山方舟、腾讯云等第三方的 DeepSeek Coding Plan,首月一般 7 到 9 元。

Kimi K2.6

4 月 20 日发布。月之暗面在编程能力上此前一直被社区质疑,这次官方定位只有一句话:「我们最强的代码模型」。

最能说明 K2.6 实际水平的不是跑分,是社区里的实测案例。有开发者让它自主重构一个有 8 年历史的金融撮合引擎 exchange-core,模型连续运行 13 小时,迭代了 12 种优化策略,修改超过 4000 行代码,峰值吞吐提升 133%。另一个是用 Zig 从零实现推理引擎,自主运行 12 小时,做出的引擎比 LM Studio 快 20%。不停地自主跑十几个小时不偏航——这种长程自主能力过去只在 Claude Opus 上见到过。linuxdo 上也有用户反馈 K2.6 的编程能力确实比 K2.5 有明显提升,但前端以外的场景评价不一。

我目前给客户推荐的一个实际方案就是用 Kimi 做自动化提交外链。外链提交是 SEO 里一项核心但极其耗时的工作——需要访问几十上百个不同网站,注册账号、填表单、发布内容。我前后测试过三套方案。Codex 安全审查太严,连合法的目录站提交都拒绝执行。Claude 技术上能做,但按量计费成本偏高,更麻烦的是国内用户账号频繁被封,跑到一半突然没了。Kimi K2.6 在这个场景上表现意外地好——能理解不同站点的页面结构,自主完成注册和提交全流程,遇到异常页面会调整策略。客户反馈整体正面。

但测试中碰到几个问题需要提前知道。第一是速度确实慢,模型体量大,长流程任务的响应延迟肉眼可见。第二是工具调用的稳定性不够好,时不时会碰到 400 报错,linuxdo 论坛上有不少人反馈 K2.6 发布后这个问题仍然存在。第三是高峰期和 GLM 一样容易排队。

订阅分三档——入门 39 元含 K2.6 加 Agent 加 PPT,中档 Allegretto 199 元,高档 Allegro 559 元,学生版 49 元。

GLM-5.1

智谱 3 月 27 日发布,官方公告只有一句话:「GLM-5.1 现已面向 GLM Coding Plan 全部用户开放」。没有发布会,没有通稿。

智谱自己展示的核心案例是 8 小时从零搭建一套完整的 Linux 桌面环境——窗口管理器、状态栏、VPN 管理器、中文字体、游戏库,1200 步操作全自主完成,产出 4.8MB 配套文件。另一个是向量数据库优化,模型只拿到目标和初始代码,自主跑了 655 轮迭代,查询性能从 3108 提升到 21472,6.9 倍。优化路径不是一条直线——检索方式太慢就自行换架构,精度下降就引入压缩,速度还不够就加粗筛,最后叠加路由和剪枝。每一次技术路线的切换都是模型自主发起的。这两个案例如果属实,能力确实很强,但需要留意它们目前仅由智谱自己完成,独立复现报告还没有出来。模型本身的能力在测试中确实不错,跑长程任务的稳定性可以接受。

但使用体验上有几个现实问题。高峰期服务器经常过载,排队等位甚至直接不可用——论坛上这一条被反复提到,有用户说”严重超载高峰期基本不可用”。2026 年的一轮调价把订阅费翻了一倍多——Lite 从之前的二十多涨到 49 元,Pro 从一百出头涨到 149 元,Max 涨到 469 元——涨价幅度在四家里最大。linuxdo 上有用户直接说”涨价不给退款”,老用户的体验很差。新用户首次季付可以打五折。上下文窗口 200K 是四家中最短的。

MiniMax M2.7

3 月 19 日发布,最小版本激活参数只有 10B,是四家中最轻量的。订阅入门 Starter 29 元每月(5 小时 600 次请求,仅限编程),中档 Plus 49 元含图像和音频生成,Max 119 元全多模态含视频。

速度是测试中最直观的感受——每秒 100 token 输出,大约是其他模型的两倍,同样的任务别家要等十几秒,M2.7 几秒就出结果。测试中用它跑过批量文案生成和内容摘要,速度差距非常明显。

文字处理上 M2.7 有一个反直觉的表现——润色、摘要这类文字生成任务,它的实际质量比综合能力强得多的模型还好。测试中在文案和摘要场景比较好。

也有客户试过用 MiniMax 提交外链。结构简单的博客平台——标准化表单填写标题、正文、链接——确实能胜任,速度快成本低。但复杂站点(多步注册、邮箱验证、定位提交入口)推理链条容易断,成功率明显下降。

但 M2.7 有一个结构性缺陷。我在测试中碰到过一次——给它一道稍微复杂的数学题,模型陷入推理死循环,反复输出同一句话几千次,完全退不出来。碰到这一次之后我就再没把任何需要严密推理的任务交给它。这不是偶发——知乎洛小山的独立评测报告专门记录了这个现象,linuxdo 社区也有多人反馈。文字和速度敏感的场景用它最划算,推理任务不碰。

怎么分流

跑完一圈之后的结论是,如果你想把一部分任务从 Claude 上分流出去,不能只看价格。实际测下来发现成本只是三个变量之一,另外两个是上下文容量和任务持续时长。以下是我根据测试结果做的分流建议。

大文档和大代码库的处理推荐 DeepSeek V4-Flash。100 万 token 的上下文窗口在四家中没有替代品,按 API 计费月开销不到 50 块,同样的任务用 Claude 每月要几百块。linuxdo 有用户总结得很直接:”不限速速度快,就算 Flash 都很好用。”

长程后台任务推荐 GLM-5.1 Pro,每月 149 元。数据库优化、代码重构、测试生成这些任务的共同特征是不需要人工监督、单次运行时间长、对中途稳定性要求高。我也考虑过 Kimi K2.6(社区验证过 13 小时连续编码的表现),但 Kimi 中档订阅 199 元比 GLM Pro 贵 50 块,后台任务对代码创造力要求不高,GLM 性价比更合适。需要注意 GLM 高峰期排队的问题,后台任务尽量避开晚高峰。

批量内容生产推荐 MiniMax Starter,每月 29 元。长尾文案、批量摘要、大量结构化内容,这些任务对速度和成本敏感,对推理深度没要求,M2.7 每秒 100 token 的输出速度优势明显。硬性前提是任务中不能包含数学推理。

自动化网页操作推荐 Kimi K2.6。外链提交是一个典型场景——AI 需要自主访问不同网站、理解页面结构、完成注册和表单填写。这类任务我实际测试过三个方案:Codex 因为安全审查直接拒绝执行,Claude 因为成本和国内封号风险不适合长期使用,Kimi 在稳定性和成本之间找到了可接受的平衡点。如果只是结构简单的博客平台提交,MiniMax 也能覆盖,成本更低。

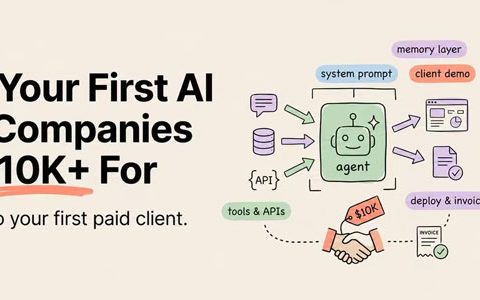

日常主力编程和复杂推理我自己继续留在 Claude 上。我目前的工作流是两个 Claude Code Max 加 Codex Pro,工具链全部围绕这套东西搭建——IDE 插件、快捷指令、提示词模板全部适配。单点切换到国产模型带来的适配成本会抵消模型本身的性价比优势。但如果你是从零开始搭建工作流,用 Kimi 入门档替代 Claude 每个月可以省下 1400 块。

三家国产订阅叠在一起每月两百出头(入门档全选只要 117 块,按推荐配置走大概 217 块),覆盖的场景比只用 Claude 宽了一截。

国产模型目前的价格不会永远维持在这个水平。Kimi K2.6 发布时把 API 价格上调了 58%,GLM 的订阅档也在 2026 年全面调价,比半年前贵了一倍。窗口还在,但在收窄。

本文来自转载百年 AI×出海 ,不代表发现AI立场,如若转载,请联系原作者;如有侵权,请联系编辑删除。

微信扫一扫

微信扫一扫