DeepSeek V4才发布一天,网上的解读就已经铺天盖地了。

但比较魔幻的是,官方的技术报告其实也就 50 来页,里面确实披露了一些训练方法、模型结构之类的细节。

但很多外界最关心的核心问题,其实并没有讲得那么细。例如:用了多少算力、训练的硬件具体是什么、包括成本等。

但网上已经出现了各种各样的解读,从各种高度、各种角度切进去,特别热闹,特别逗。

我们群里有人打了一个比方,我觉得就很形象。他说:这就像“红学”,连曹雪芹本人都不知道,原来《红楼梦》有这么厉害。

这就是比较魔幻的地方。

大家都知道 DeepSeek 是滔天流量,所以都想抓住这一波,都想蹭一下。

结果信息一多,对于真正想了解事情真相的人来说,反而就变成了一种信息过载,越看越乱,越看越不知道重点在哪里。

所以我觉得还是要回到 DeepSeek 官方的那句话:“不诱于誉,不恐于诽。率道而行,端然正己。”

过度的赞誉和过度的嘲讽都没有太大意义,我们还是应该尽量客观地来看待这些事情。

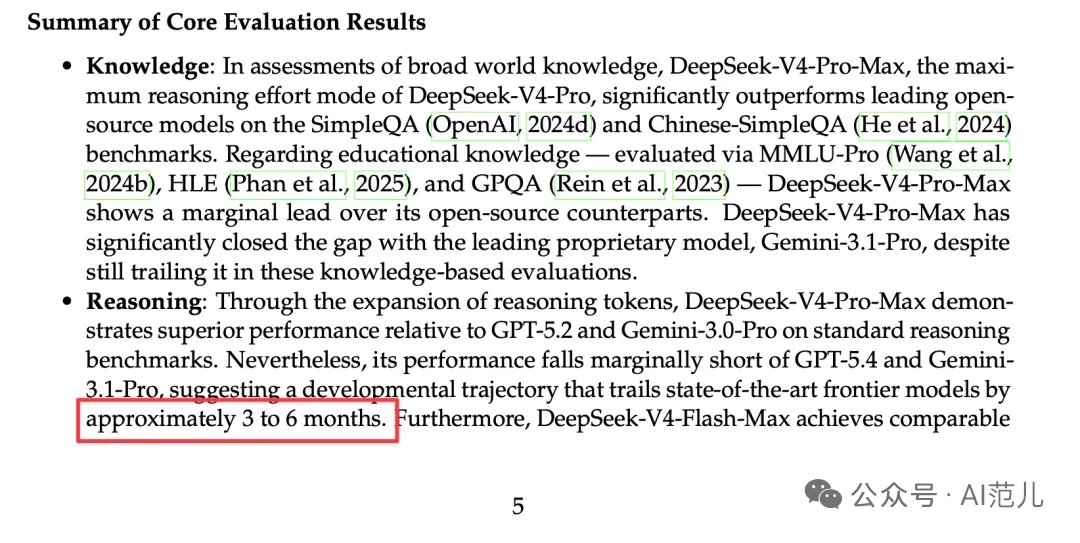

客观地来讲,DeepSeek 到底怎么样,其实大家也不用猜了,它的技术报告里面写得非常清楚。在推理任务上,离真正的顶级模型大概落后 3-6 个月。

但其实,GPT 5.4 发布到现在已经快2个月了,而正巧这周又发布了 GPT 5.5,所以实际的差距可能还不止 3-6 个月。

很多人可能会觉得很失望(甚至唱衰),但我反而是在这点上很佩服他们。

他们不会因为外界期望高,就睁眼说瞎话,或者搞一个漂亮的跑分糊弄你。

我们其实看到过不少这样的模型,上来就对标国外的顶级模型,跑分也特牛逼,结果一用发现其实是一坨屎。

我知道很多人很难接受这种落差,因为从 R1 到现在已经一年多了,这么长的时间远远超过了任何一家公司模型的发布周期。

所以很多人一直以为 DeepSeek 在憋个大的,期望值拉满。大家在等的不仅是一个顶级模型,还是另一个“DeepSeek 时刻”。

但现实不是短剧,也不是爽文。不能期待每一次登场,都能立刻炸翻全场。

而我个人觉得,这次真正的意义,反而不在于它能不能立刻对标某个顶尖模型。

更重要的是,DeepSeek 在这次技术报告里,第一次很明确地把国产芯片(华为昇腾)也放进了自己的技术验证范围。

说白了,它不只是在英伟达这套芯片体系上跑,也开始认真适配华为昇腾这一套国产算力体系。

当然,这里也要说清楚:这并不等于 V4 的完整训练过程已经全部放在昇腾上完成。

官方并没有这么说。

但至少可以说明一件事:DeepSeek 已经不只是在做一个模型,而是在尝试让自己的模型适配更多算力底座。

这件事可能比跑分更重要。因为大家都知道,现在 AI 最大的瓶颈之一,就是算力。

特别对我们国内公司来说,很多时候不是没有模型思路,也不是没有工程能力,而是最关键的高端芯片和算力供给,被卡得死死的。

所以 AI 到后面拼的,不只是模型聪不聪明,还要看它能不能便宜地、大规模地、甚至在国产算力上跑起来。

如果未来真能在英伟达之外,也跑出一条相对稳定的路线,那影响的就不只是 DeepSeek,而是整个 AI 产业的成本结构和供给结构。(老黄其实早就担忧了)

当然,这件事一定不会轻松。

从一套成熟生态,切到另一套还在成长中的算力体系,里面会有大量适配、调优、踩坑和重做。所以从 R1 到 V4 隔了这么久,可能不只是“憋大招”,而是在啃一块更硬的骨头。

另外一方面,大家可能会看到,这一次 DeepSeek V4并没有像 R1 那样在海外引起那么大的轰动。

我记得之前那次(R1),其实反而是在国外先火起来,然后国内的一些媒体才开始跟进。我其实也是在那个时候,先看到国外的大 V 转发,后来才真正去研究的。

但这一次,海外的反响确实明显平淡了很多。到现在为止,很多人的注意力还停留在前几天发布的 ChatGPT Images 2 上面。

还有一个很有意思的对比点:之前那次 DeepSeek 引发了英伟达股价大跌,最高跌幅接近 20%。

而这一次,市场反应没有像 R1 那次那样恐慌,英伟达反而在时隔六个月之后,市值再次突破了 5 万亿美元。

这说明,大部分人其实还是在关注模型到底强不强,或者说是不是用了极低的成本来训练模型。

DeepSeek 的报告里面还有一个可能会被很多人忽略的点,就是在它的致谢名单里面,他们明确地把那些离职的都标了出来,然后有人还去做了个统计。

这个结果大概是说,DeepSeek 的研发和工程团队离职率只有 3.7% 左右。

这个数字我们也不需要过度解读,但也许可以说明 DeepSeek 核心团队还是非常稳定的。

大模型拼到最后,不只是拼一次爆发,也是在拼长期工程能力和组织韧性。

当然这里面确实有一些非常重磅的人物离开。比如说:第一代大模型的核心作者(据说去了腾讯)、R1 的核心作者(据说去了字节)、OCR系列的核心作者。

但其实这也不是什么个案,国内这些大模型公司这几年,我印象中核心人物基本都换了一轮吧?

所以我觉得对 DeepSeek V4 最好的态度,还是不要着急去下结论。

它当然不是一次能封神的发布,也没有复刻像之前那种全球刷屏的时刻。但如果我们只盯着它有没有打败最强模型来判断,可能会错过一些更重要的东西。

大模型发展到今天,竞争其实已经早就不只是模型参数、跑分,或者媒体的声量了。它背后还有一系列复杂的支撑体系:算力、工程、成本、供应链管理、团队的韧性。

DeepSeek V4 真正值得关注的,也许正是那些不那么热闹但更底层的东西。

所以别神话,也别唱衰。

一个模型可以有代差,但一套系统如果真的开始跑出来,后面会发生什么,可能才是真正值得观察的地方。

本文来自转载微信公众号“AI范儿” ,不代表发现AI立场,如若转载,请联系原作者;如有侵权,请联系编辑删除。