据动察 Beating 监测,《The Information》援引知情人士和腾讯内部备忘录披露,腾讯员工在开发 Hy3 模型的后训练阶段使用了 Anthropic 的 Claude Code,尽管 Anthropic 以国家安全为由明确禁止向中国公司提供商业服务。

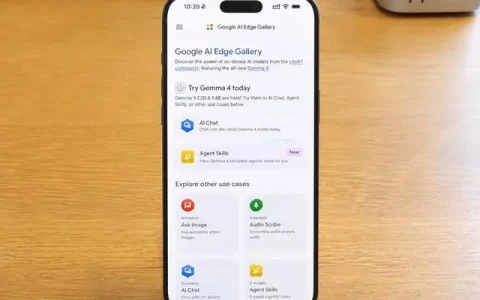

Hy3 是腾讯混元系列迄今最强的大语言模型,295B 参数 MoE 架构,去年底加入腾讯的首席 AI 科学家姚顺雨主导开发。在 RLHF(基于人类反馈的强化学习)阶段,腾讯组织员工充当人类评估员,公司内部备忘录提供了 Claude Code 的安装指南,每人用量上限为「数千个 token」。

腾讯员工不认为这属于蒸馏(用强模型的输出训练弱模型)。他们的做法是:向两个匿名模型提出相同编程问题,盲评打分;同时用 Claude Code 实时生成高质量行为示例作为参照,帮助筛选低质量响应。多家 AI 公司的员工证实,在后训练中用业内领先模型做基准参考是常见做法。

Anthropic 发言人表示,公司安全团队「主动监控蒸馏攻击,发现后立即采取行动」,但未直接回应腾讯使用 Claude Code 一事。中国公司和开发者获取 Claude 的常见方式是通过中间商、非中国手机号或信用卡注册。Anthropic 本月初已收紧身份验证要求,部分用户须提供政府签发的证件照和本人照片。

本文来自转载动察Beating ,不代表发现AI立场,如若转载,请联系原作者;如有侵权,请联系编辑删除。