“你花在 AI 编程上的费用,90% 都浪费在了没必要上传的上下文里!”

刚刚,X上的一位技术博主 Ronin 分享了一篇干货满满的博客《如何把 AI 编程账单砍掉 80%》。

他给出了一个切身案例:他的每月 AI 编程开销从4200 美元降到了 312 美元!而且是在没有换新工具、没有减少项目交付产出,也没有换成便宜的“平替”的情况下!

并且得出了一个反常识的结论:想要控制好 AI 编程成本,先管好上下文,再选对模型。

那么,他是如何做到的?

一次随手补代码,为什么能跑出 5 万 Token?

Ronin 认为:“并非模型太贵,而是你在为懒惰买单。”

2026 年,氛围编程者的成本曲线经历了前期平缓、后期陡升的走势。

Claude Code、Cursor、Aider、Windsurf—— 这些工具都遵循同一套成本逻辑:输入消耗 token,输出也消耗 token,每百万 token 定价 X 美元。用这些工具开发得越多,烧掉的 token 就越多,账单也随之水涨船高。

当我们刚开始入门氛围编程的时候,往往处于GPT-3.5 免费或者低收费时期,但现在工具的运行逻辑已经完全不同了:模型更智能,也更贵了(Opus 4.6 的输入成本约为两年前 GPT-3.5 的 10 倍);工具自动携带的上下文越来越多(Cursor 的自动上下文、Claude Code 的仓库感知(repo awareness)、各类 IDE 标配的「@- 全量文件」功能);智能体式工作流(agentic workflows)成默认(所有工具都在跑多步骤循环,且每一步都要全额计费)。

所以可能就会出现,只是随手写点代码,工具却在后台跑着 50,000 token 的循环,账单在不知不觉间飙升。

五大“隐形陷阱”,正在掏空你的钱包

陷阱1:每轮对话都重发整个代码库

Cursor 或 Claude Code 的自动上下文会在每次提问时,都带上同样的 30–50 个文件。这些文件明明没变,但你每一轮都在为它们付费。

我们来算一笔账:一个 50 文件的上下文 ≈ 80,000 输入 Token。按 Opus 定价,每轮 1.20 美元。

每天 50 轮 = 60 美元 / 天;每月仅这项就 1,800 美元。

陷阱2:工具调用循环

Agent 调用工具、拿到数据、重发全量上下文、再调用工具、再重发……

这一套流程跑下来,Agent 的每一句“我检查一下”,都要全额重付一次输入成本。等它算完,你可能已经为同一个 5 万 Token 的上下文付了 5 次钱。

陷阱3:大材小用,小任务用大模型

改个错别字、格式化 JSON、全局重命名变量等任务交给 Opus ,模型思考 12 秒,烧掉几千 Token,实际是这些活便宜模型完全能搞定。

陷阱4:错误的流式/批量选择:明明可以批量处理的场景,却用了流式

流式输出会让某些工作流的提示缓存失效;而明明可以批量的场景用流式,又白白浪费时间与 Token。

陷阱5:上下文膨胀

不确定要不要 utils.ts → 带上;不确定要不要测试文件 → 带上;不确定要不要 schema → 带上……

结果一句修这个 bug,提示直接飙到 80,000 Token。

别再一个模型打天下,四层模型决策体系出炉!

问题说完了,我们来看一下解决方案:

路由架构:根据任务类型将工作分配到多个模型上

多数氛围编程者习惯用一个模型处理所有事:要么全用高级模型(Opus,成本极高),要么全用廉价模型(Haiku,关键任务质量下滑)。而大多数人默认的折中方案(全用 Sonnet),实则是两头不讨好:成本比实际需求高 6 倍,繁忙时段还容易触发速率限制。

路由决策树(四层模型体系)

高级层(关键决策专用):

规划、架构设计任务选择 Opus 4.6 或 GPT-5,这类 10% 的关键决策会产生长期影响,值得高成本投入。

主力层(核心交付工作):

代码实现、审查、重构、调试等核心编码任务选择 Kimi 2.6;多轮迭代的复杂智能体任务也是 Kimi 2.6

日常主力模型,Kimi 2.6 性价比超高,交付质量与 Sonnet 相当,成本低 6 倍,并且每次迭代的成本优势会持续累积,长期节省显著。

轻量层(清理执行类任务):

代码检查、格式化、单行修改、简单修复选择 轻量模型(Haiku 4.5)或 IDE 自动补全。

本地层(零成本基础任务):

模板代码、自动补全、桩代码生成选择本地模型(通过 Ollama 部署 Qwen 3)

同时,Ronin 还给出了一些模型的选择建议:

- 如果只能选择一个模型:2026 年首选Kimi 2.6,高质覆盖 90% 场景,成本最低。

- 双模型方案:Kimi 2.6 + Opus,精简专业配置,比全 Sonnet 节省约 70% 成本。

- 大规模部署:全路由架构(Opus/Kimi/Haiku/ 本地),保证成本的同时确保任务质量。

多数氛围编程者的误区是因 2024-2025 年的营销默认用 Sonnet,但 2026 年成本质量的格局已变:Kimi 2.6 质量追平,价格优势巨大。坚持用 Sonnet,等于白白浪费账单里的60%-70% 。

七种实用技巧,直接砍掉80%的账单

技巧1:但凡支持提示缓存,全部开启

Anthropic、OpenAI、Moonshot 现已支持提示词缓存,缓存后的 Token 费用,仅为普通输入成本的10%。

把固定不变的稳定上下文(CLAUDE.md、系统指令、代码库全局概述)放进缓存前缀;

按 5 分钟 为单位拆分工作块(匹配缓存 TTL 有效期)。

- Claude Code:系统提示、CLAUDE.md 默认自动缓存

- Cursor:设置 → 模型 → 开启(使用提示缓存)

- Aider:启动参数加上

--cache-prompts

技巧2:拉取代码前,先执行 Grep

别再抱着以防万一的心态就把整个文件全塞进上下文。

先用 grep/ripgrep 检索代码符号、关键字,只引入真正相关的代码片段。

rg "useUserAuth" --type ts -l # find files

rg "useUserAuth" --type ts -B 5 -A 20 # find usage with context技巧3:分析所有的工具调用

花一周时间,记录每一次工具调用的输入、输出 Token 消耗。

你会明显发现:大量螺旋嵌套循环、反复重复拉取同一份数据的冗余调用。

在 Claude Code 中快速记录日志:开启 --verbose-tools 把日志输出到文件,再用 grep 统计分析,精准定位头号 Token 消耗大户。

多数开发者只要修好最耗成本的3 个无效工具循环,就能直接省 30%–50% 开销。

这一套小连招下来,大多数氛围编程者,只要修复掉最严重的三个工具调用循环,就能直接砍掉 30%–50% 的开销。

技巧 4:采用渐进式技能模式

一套工作流程跑通稳定后,直接保存为 SKILL.md 技能文档。后续 AI 智能体直接加载这份技能,跳过重新摸索、重新推演的探索阶段。

举例:Ronin 原本部署到测试环境流程,用 Opus 每次要花 4 美元,只因智能体每次都重新解析环境配置。写成 SKILL.md 固化流程后,切换到 Kimi 2.6 运行,单次成本降到 0.18 美元,而交付结果完全一致。

技巧 5:样板代码、自动补全改用本地模型

在 Ollama 本地部署 Qwen 3 / Llama 3,全程零 Token 费用,跑在自己笔记本上即可。

适合用本地模型:代码自动补全、日常输入提示、简易代码补全、语法纠错、空桩函数生成。

5 分钟就能够快速部署:

brew install ollama

ollama pull qwen3:7b

ollama serve再把 IDE 自动补全接口指向localhost:11434即可。

技巧 6:长会话主动精简总结

每进行 10–15 轮对话,就让 AI 总结:已完成工作和下一步计划。舍弃冗长原始聊天记录,只保留摘要作为新上下文,开启下一轮任务。

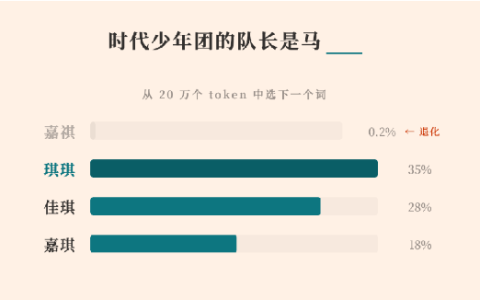

一场原本 20 万 Token 的长会话,可以压缩到仅 5000 Token 摘要。

后续接续工作的成本,只相当于继续沿用旧上下文的 5%。

技巧 7:把零散小请求合并批量处理

不要把 10 个小问题分 10 次单独提问 ——10 次独立 API 调用等于 10 次重复收取上下文前缀费用。

正确做法是合并成一条提示批量下发:

按 1–10 编号,依次回答以下 10 个问题

实际运行的配置:直接抄作业!

Ronin 还给出了他目前使用的配置,复制粘贴就能使用:

# ~/.config/claude-router/config.yaml

# Kimi 2.6 is the default for nearly all serious work

default: kimi-2.6-instruct

routes:

# planning / architecture / complex decisions

planning:

model: claude-opus-4-6

fallback: gpt-5

triggers:

- "plan"

- "architect"

- "design system"

- "refactor architecture"

- "security review"

# serious implementation, code review, debugging, refactoring (the bulk of real work)

implementation:

model: kimi-2.6-instruct

triggers:

- "review"

- "debug"

- "cross-file refactor"

- "implement"

- "build feature"

# most coding tasks (default workhorse, same as implementation, Kimi 2.6)

default_implementation:

model: kimi-2.6-instruct

# cleanup, lint, format, single-line edits

cleanup:

model: claude-haiku-4-5

triggers:

- "lint"

- "format"

- "fix typo"

- "rename variable"

# boilerplate, autocomplete (local, free)

boilerplate:

model: ollama:qwen3:7b

triggers:

- "autocomplete"

- "stub"

- "generate boilerplate"

caching:

enabled: true

prefix_cache: true

context:

max_tokens: 50000

auto_summarize_after: 15 # turns

use_grep_first: true写在最后

除了上面写的硬核技巧之外,Ronin 还规划了一个“30天计划”。

第一周:先减少“无意义上下文”

第二周:默认模型切换为 Kimi 2.6,仅供规划层使用的预留 Opus / GPT-5

第三周:重点排查 Agent 工具循环

第四周:建立“Skill系统” + 本地模型

在 Ronin 看来,“到2027年胜出的开发者,未必是那些拥有最佳模型的开发者。而是能够管好上下文、合理调度模型的人”

很多开发者直到看到账单时才发现:真正贵的,可能不是模型本身,而是那些根本没必要发送的上下文。

有没有已经尝试过这套玩法的大佬,欢迎在评论区分享经验!

参考链接:

https://x.com/DeRonin_/status/2054235707791778034?s=20

本文来自转载51CTO技术栈 ,不代表发现AI立场,如若转载,请联系原作者;如有侵权,请联系编辑删除。

微信扫一扫

微信扫一扫