DeepSeek-V4发布几周,很多人问能不能本地跑。

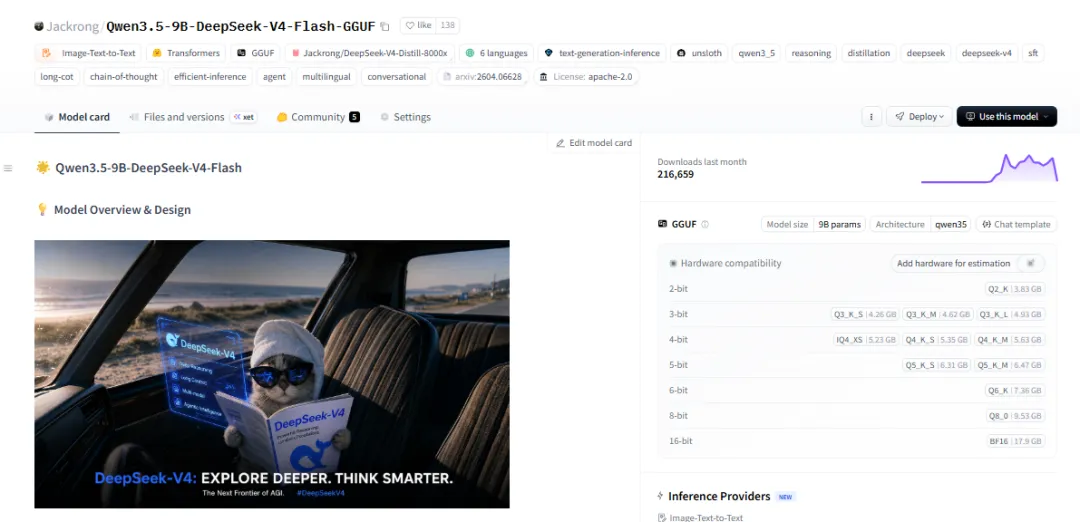

官方的完整版参数量太大,普通电脑根本跑不动。但社区动作很快,有人基于Qwen3.5-9B做了一个蒸馏版,发布三天下载量就好几万,模型叫Jackrong/Qwen3.5-9B-DeepSeek-V4-Flash-GGUF。

我去实测了一下,说说结果。

先说什么是蒸馏版。

用DeepSeek-V4-Flash的高质量推理数据,去增强一个9B的小模型,让它尽量学到结构化推理、多步分析和工具调用能力。

GGUF的Q4_K_M版本大约5.63GB,普通电脑有机会跑起来。代价是参数量只有9B,复杂推理能力肯定不如原版,但体积小、部署门槛低,是本地体验V4推理风格的最低成本方案。

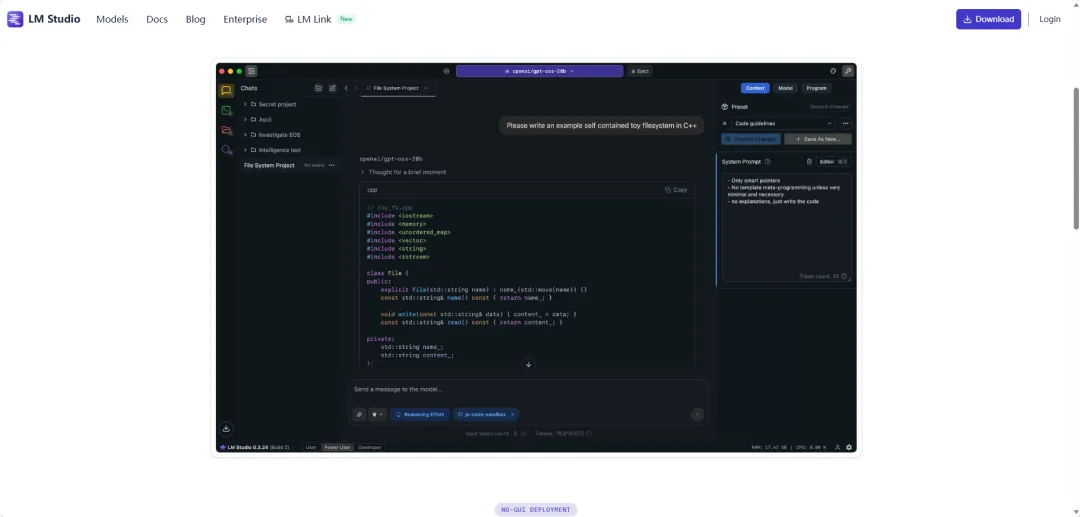

三分钟部署方案

用LM Studio,搜索Jackrong/Qwen3.5-9B-DeepSeek-V4-Flash-GGUF,找到后直接下载,等下载完成加载就能用。

没有LM Studio的先去官网下一个,整个流程不超过三分钟。

测评,蒸馏后的9B有没有真的学到V4的推理风格

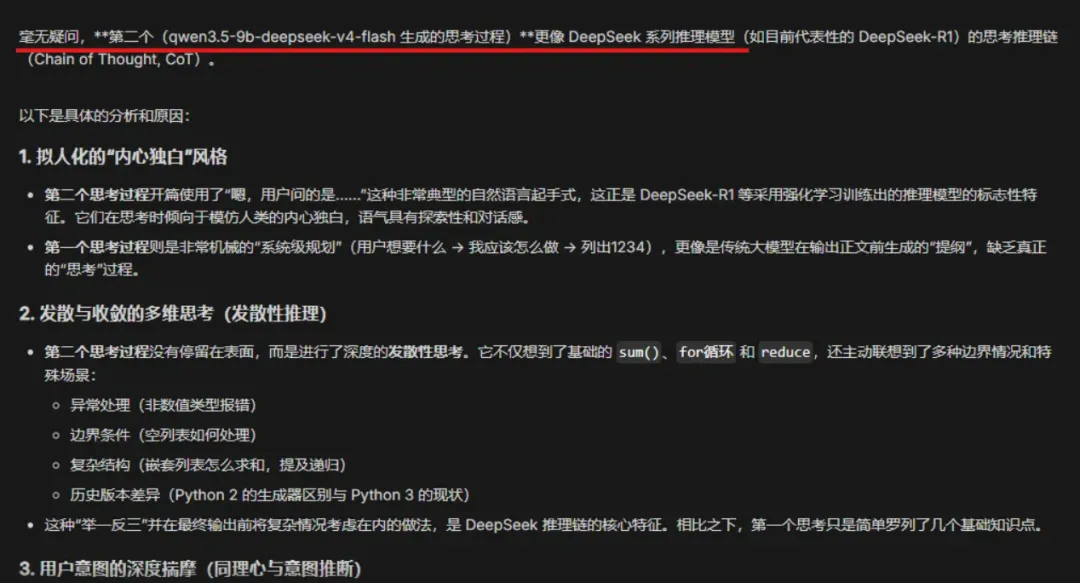

我拿同一道编程题,分别问了原版Qwen3.5-9B和蒸馏后的9B,把两个模型的思考过程截图发给Gemini-3.1-Pro,让它评判谁更像DeepSeek-V4。

Gemini给出的结论,蒸馏后的9B更像。

原因说得很清楚,原版9B的输出更像一个「写作大纲」,直接给结论然后规划结构。蒸馏后的9B展示了完整的推理链,从接收问题到评估意图,到检索知识,到考虑边界条件,到权衡优缺点,到确定回答策略,一步步来,和DeepSeek推理模型那种长思考、慢决策的风格很像。

换句话说,蒸馏这件事是有效果的,9B模型确实学到了一些东西。

整体感受说一下。

蒸馏版能不能完全替代DeepSeek-V4?不能,9B就是9B,复杂任务还是有差距。

但如果你的目标是在本地低成本体验V4的推理风格,用来跑知识库、测试Agent工作流、做一些轻量的自动化任务,这个蒸馏版5.63GB、普通电脑就能跑,已经超出预期了。

感兴趣的去LM Studio搜Jackrong/Qwen3.5-9B-DeepSeek-V4-Flash-GGUF,下下来试试。

以上,既然看到这里了,相信是有所共鸣。随手点个赞、在看、转发三连,想第一时间看到新内容,给我个星标⭐即可。感谢陪伴,文字因你而完整,下次见。

本文来自转载科技前沿AI ,不代表发现AI立场,如若转载,请联系原作者;如有侵权,请联系编辑删除。

微信扫一扫

微信扫一扫