特别是对于咱们个人开发者写个小工具,一天调用个几百次轻轻松松。Agent 流程跑起来,几百次调用眨眼就没了。一个月下来,这笔开销积少成多咱也受不了。

但最近挖到一个宝藏——阿里云魔搭社区(ModelScope)的免费推理 API,每天能白嫖 2000 次,而且支持 Qwen3、DeepSeek-R1、GLM-4.5 这些主流大模型。关键是,接口完全兼容 OpenAI 协议,改两行代码就能用。

废话不多说,直接上干货。

先说重点:这平台靠谱吗?

魔搭社区,阿里云旗下的开源模型平台,业内叫它”中国版 Hugging Face”。

说几个数据你就明白了:

- 模型库:2 万 + 模型,涵盖 LLM、多模态、文生图、语音、代码等全领域

- 免费额度:每天 2000 次推理调用(所有模型共享)

- 协议支持:OpenAI + Anthropic 双兼容

- 刷新机制:每天 0 点自动重置,永久免费,不会扣费

注意:这 2000 次是总限额,不是每个模型都能调 2000 次。具体每个模型的限额后面会详细说,到时候可别怪我没说清楚哦。

怎么开通?三步搞定

第一步:注册魔搭账号

访问 modelscope.cn,用手机号或阿里云账号注册。

第二步:绑定阿里云账号(必做!)

这一步很多人会漏掉,不绑定的话调用 API 会报错。

路径:魔搭个人中心 → 账号设置 → 绑定阿里云账号

第三步:获取访问令牌

个人中心 → 访问令牌 → 创建新令牌 → 勾选”大模型推理”权限

建议把 Token 有效期设为”长期有效”,一次性配置好,以后都不用管。

每天 2000 次,哪些模型能用?

魔搭支持近 3000 个模型的推理 API,下面是几个主力模型的每日免费额度:

大语言模型(主力推荐)

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

注意:DeepSeek-R1 这种深度推理模型,每天只有约 200 次,比较紧张。

文生图模型

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

文生图的额度普遍偏少,每天 50 次左右,适合轻度使用。

多模态和语音

- 多模态理解:Qwen2.5-VL-72B、Qwen-Omni

- 语音识别:SenseVoice、FunASR

- 语音合成:CosyVoice

怎么调用?三种调用方式供选择

方式一:OpenAI 兼容(最推荐)

魔搭的 API 格式和 OpenAI 完全一样,你只需要改两行代码:

from openai import OpenAI

client = OpenAI(

api_key="你的魔搭 Token", # 这里填魔搭的 Token

base_url="https://api-inference.modelscope.cn/v1/"# 改这个地址

)

response = client.chat.completions.create(

model="Qwen/Qwen3-235B-A22B-Instruct",

messages=[{"role": "user", "content": "用 Python 写个快速排序"}],

stream=True

)原来用 OpenAI 接口的代码,基本不用改逻辑,只换 base_url 和 api_key 就行。

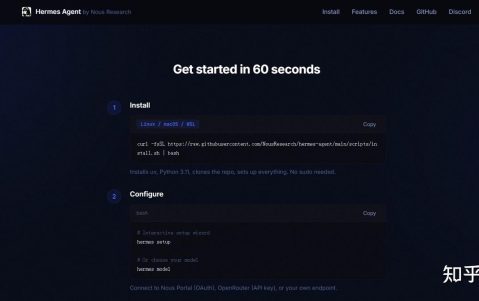

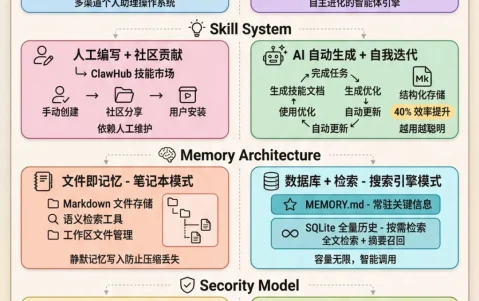

方式二:Anthropic 兼容(给 Claude Code 用的)

魔搭居然还支持 Anthropic 协议!想用魔搭的接口跑 Claude Code,设置这三个环境变量:

export ANTHROPIC_BASE_URL=https://api-inference.modelscope.cn/compatible-mode/v1/

export ANTHROPIC_API_KEY=你的魔搭 Token

export ANTHROPIC_MODEL=Qwen/Qwen3-Coder-480B-A35B-Instruct方式三:文生图专用API接口

import requests

response = requests.post(

"https://api-inference.modelscope.cn/v1/images/generations",

headers={"Authorization": "Bearer 你的魔搭 Token"},

json={

"model": "MAILAND/majicflus_v1",

"prompt": "一位身穿西装戴着墨镜的男士手里拿着一束鲜花正看着前方"

}

)哪些工具能接?

魔搭的 OpenAI 兼容接口意味着一件事:几乎所有支持自定义 API 的工具都能接。

|

|

|

|

|---|---|---|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

简单来说:只要能改 base_url 的地方,魔搭都能接。

最后总结一下

魔搭社区 就是中国版的 Hugging Face

核心优势:

-

✅ 每天 2000 次免费 API(永久刷新,不会扣费) -

✅ OpenAI + Anthropic 双协议兼容,接入超简单 -

✅ 2 万 + 模型,LLM、多模态、文生图、语音全覆盖

适合谁用:

-

个人开发者做小工具 -

AI 应用原型验证 -

多模型测试对比 -

学习 AI 开发

最关键的是:这是每天都能白嫖的,不是一次性羊毛。

本文来自转载AI达人圈 ,不代表发现AI立场,如若转载,请联系原作者;如有侵权,请联系编辑删除。